:-:

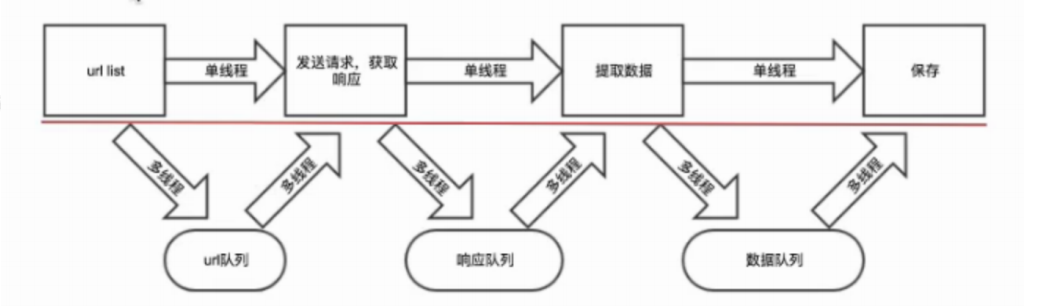

多線程與單線程爬蟲流程圖

```python

"""

@Date 2021/4/5

"""

import requests

from lxml import etree

from urllib import request

import threading

from queue import Queue

class Producer(threading.Thread):

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36',

'Host': 'www.doutula.com',

'Cookie': '__cfduid=d0482fd98715b92c3742dd452c58abe991582206241; UM_distinctid=17062d74e572d0-06f72cf9e39479-2393f61-1fa400-17062d74e595e0; CNZZDATA1256911977=1187705542-1582204806-%7C1582204806; _ga=GA1.2.188432079.1582206243; _gid=GA1.2.321283468.1582206243; __gads=ID=b074b5de9483e3e6:T=1582206242:S=ALNI_MY0LJl_kXttlOHBqkHIVODQTtkVmQ; _agep=1582206244; _agfp=698bc2e12789df094f2cdcc72a7f6225; _agtk=e92fbe464dff15783076bd9190dd965b; XSRF-TOKEN=eyJpdiI6IktrNHNhRUdBNDNtbENxOU5TdnBZUXc9PSIsInZhbHVlIjoiVTE5eVZTbWdTNTJyRmJwdnBcLzhieVlSb2YzMFNjQlNzMEN6YlNiSXJ0NXpBNnA3YjNwcUxNTFFGdEpjbWRDenUiLCJtYWMiOiI0MWFjYzRkN2RlYjMwNDI0OWI2YTc0Y2VhNjQ4ZTkyNGZkOGFmYmU4YTk5ZTUzNzU4M2FhYjMzMzEzOTk3MWZlIn0%3D; doutula_session=eyJpdiI6InRaa09IWis4K0Jic2pIdm9tNnlJWUE9PSIsInZhbHVlIjoianc5QUV4WGYrMFA1R2g1S3pNU2tGU2g5b1RPVG8yaDEwenRuXC9Vdk8rZW5MN0dqbTNNSUpsWjVIMmhDWHJPcjkiLCJtYWMiOiI0OTUxZDQxMThmMmFhMDcyZDAwZGYxNGViY2JhOGQ3Mjg0MzY0MDgxNjExMTE5NGQ3NmYwMGEwNTYzMDM3MDEwIn0%3D'

}

def __init__(self, page_queue, img_queue):

super().__init__()

self.page_queue = page_queue

self.img_queue = img_queue

def run(self):

while True:

if self.page_queue.empty():

break

url = self.page_queue.get()

self.parse_page(url)

def parse_page(self, url):

response = requests.get(url, headers=self.headers)

text = response.text

html = etree.HTML(text)

imgs = html.xpath("//div[@class='page-content text-center']//img")

for img in imgs:

img_url = img.get('data-original')

alt = img.get('alt')

self.img_queue.put((img_url, alt))

class Consumer(threading.Thread):

def __init__(self, page_queue, img_queue):

super().__init__()

self.page_queue = page_queue

self.img_queue = img_queue

def run(self):

while True:

if self.page_queue.empty() and self.img_queue.empty():

break

img = self.img_queue.get()

img_url, filename = img

# 將圖片保存到自己電腦的images/{}.jpg路徑中

request.urlretrieve(img_url, 'images/{}.jpg'.format(filename))

print("正在下載-{}".format(filename))

def main():

"""

Producer線程負責獲取圖片的url,Consumer線程負責將圖片寫入到磁盤中

"""

page_queue = Queue(100)

img_queue = Queue(500)

for page in range(1, 101):

url = 'http://www.doutula.com/photo/list/?page={}'.format(page)

page_queue.put(url)

for i in range(5):

t = Producer(page_queue, img_queue)

t.start()

for i in range(5):

t = Consumer(page_queue, img_queue)

t.start()

if __name__ == '__main__':

main()

```

- 爬蟲基本概念

- 爬蟲介紹

- 通用爬蟲與聚焦爬蟲

- 通用爬蟲

- 聚焦爬蟲

- HTTP與HTTPS協議

- HTTP協議簡介

- HTTP的請求與響應

- 客戶端HTTP請求

- 服務端HTTP響應

- requests庫

- requests庫簡介

- requests簡單使用

- 發送帶header的請求

- 發送帶參數的請求

- 案例:下載百度貼吧頁面

- 發送POST請求

- 使用代理

- 為什么要使用代理?

- 正反向代理

- 代理服務器分類

- 使用代理

- cookie和session

- cookie和session的區別

- 爬蟲處理cookie和session

- 使用session登錄網站

- 使用cookie登錄網站

- cookiejar

- 超時和重試

- verify參數忽略CA證書

- URL地址的解碼和編碼

- 數據處理

- json數據處理

- json數據處理方案

- json模塊處理json數據

- jsonpath處理json數據

- 正則表達式

- lxml

- xpath與lxml介紹

- xpathhelper插件

- 案例

- Beautiful Soup

- Beautiful Soup介紹

- 解析器

- CSS選擇器

- 案例

- 四大對象

- 爬蟲與反爬蟲

- 爬蟲與反爬蟲的斗爭

- 服務器反爬的原因

- 什么樣的爬蟲會被反爬

- 反爬領域常見概念

- 反爬的三個方向

- 基于身份識別進行反爬

- 基于爬蟲行為進行反爬

- 基于數據加密進行反爬

- js解析

- chrome瀏覽器使用

- 定位js

- 設置斷點

- js2py

- hashlib

- 有道翻譯案例

- 動態爬取HTML

- 動態HTML

- 獲取Ajax數據的方式

- selenium+driver

- driver定位

- 表單元素操作

- 行為鏈

- cookie操作

- 頁面等待

- 多窗口與頁面切換

- 配置對象

- 拉勾網案例

- 圖片驗證碼識別

- 圖形驗證碼識別技術簡介

- Tesseract

- pytesseract處理圖形驗證碼

- 打碼平臺

- 登錄打碼平臺

- 驗證碼種類

- 多任務-線程

- 繼承Thread創建線程

- 查看線程數量

- 資源共享

- 互斥鎖

- 死鎖

- 避免死鎖

- Queue線程

- 多線程爬蟲

- 多任務-進程

- 創建進程

- 進程池

- 進程間的通信

- Python GIL

- scrapy框架

- scrapy是什么?

- scrapy爬蟲流程

- 創建scrapy項目

- Selector選擇器

- logging

- scrapy shell

- 保存數據

- Item數據建模

- 翻頁請求

- Request

- CrawlSpider

- settings

- 模擬登錄

- 保存文件

- 內置Pipeline

- 自定義Pipeline

- 中間件

- selenium動態加載

- 防止反爬

- 隨機User-Agent

- 隨機IP代理

- settings中的參數

- 隨機延遲

- request.meta常用參數

- 分布式爬蟲

- 分布式原理

- scrapy_redis

- 去重問題

- 分布式爬蟲編寫流程

- CrawSpider改寫成分布式

- scrapy_splash

- scrapy_splash是什么?

- scrapy_splash環境搭建

- APP抓取

- Android模擬器

- appium

- appium是什么?

- appium環境搭建

- appium環境聯調測試

- appium的使用

- 演示項目-抓取抖音app

- 抖音app與appium的聯調測試

- 元素定位

- 抖音appium代碼

- 抓包軟件

- url去重處理