# 7.8 Adam算法

Adam算法在RMSProp算法基礎上對小批量隨機梯度也做了指數加權移動平均 [1]。下面我們來介紹這個算法。

> 所以Adam算法可以看做是RMSProp算法與動量法的結合。

## 7.8.1 算法

Adam算法使用了動量變量`$ \boldsymbol{v}_t $`和RMSProp算法中小批量隨機梯度按元素平方的指數加權移動平均變量`$ \boldsymbol{s}_t $`,并在時間步0將它們中每個元素初始化為0。給定超參數`$ 0 \leq \beta_1 < 1 $`(算法作者建議設為0.9),時間步 `$ t $`的動量變量`$ \boldsymbol{v}_t $`即小批量隨機梯度`$ \boldsymbol{g}_t $`的指數加權移動平均:

```[tex]

\boldsymbol{v}_t \leftarrow \beta_1 \boldsymbol{v}_{t-1} + (1 - \beta_1) \boldsymbol{g}_t.

```

和RMSProp算法中一樣,給定超參數`$ 0 \leq \beta_2 < 1 $`(算法作者建議設為0.999),

將小批量隨機梯度按元素平方后的項`$ \boldsymbol{g}_t \odot \boldsymbol{g}_t $`做指數加權移動平均得到`$ \boldsymbol{s}_t $`:

```[tex]

\boldsymbol{s}_t \leftarrow \beta_2 \boldsymbol{s}_{t-1} + (1 - \beta_2) \boldsymbol{g}_t \odot \boldsymbol{g}_t.

```

由于我們將`$ \boldsymbol{v}_0 $` 和`$ \boldsymbol{s}_0 $`中的元素都初始化為0,

在時間步`$ t $`我們得到 `$ \boldsymbol{v}_t = (1-\beta_1) \sum_{i=1}^t \beta_1^{t-i} \boldsymbol{g}_i $`。將過去各時間步小批量隨機梯度的權值相加,得到 `$ (1-\beta_1) \sum_{i=1}^t \beta_1^{t-i} = 1 - \beta_1^t $`。需要注意的是,當 `$ t $`較小時,過去各時間步小批量隨機梯度權值之和會較小。例如,當`$ \beta_1 = 0.9 $`時,`$ \boldsymbol{v}_1 = 0.1\boldsymbol{g}_1 $`。為了消除這樣的影響,對于任意時間步`$ t $`,我們可以將`$ \boldsymbol{v}_t $`再除以`$ 1 - \beta_1^t $`,從而使過去各時間步小批量隨機梯度權值之和為1。這也叫作偏差修正。在Adam算法中,我們對變量`$ \boldsymbol{v}_t $`和`$ \boldsymbol{s}_t $`均作偏差修正:

```[tex]

\hat{\boldsymbol{v}}_t \leftarrow \frac{\boldsymbol{v}_t}{1 - \beta_1^t},

```

```[tex]

\hat{\boldsymbol{s}}_t \leftarrow \frac{\boldsymbol{s}_t}{1 - \beta_2^t}.

```

接下來,Adam算法使用以上偏差修正后的變量`$ \hat{\boldsymbol{v}}_t $`和`$ \hat{\boldsymbol{s}}_t $`,將模型參數中每個元素的學習率通過按元素運算重新調整:

```[tex]

\boldsymbol{g}_t' \leftarrow \frac{\eta \hat{\boldsymbol{v}}_t}{\sqrt{\hat{\boldsymbol{s}}_t} + \epsilon},

```

其中`$ \eta $`是學習率,`$ \epsilon $`是為了維持數值穩定性而添加的常數,如`$ 10^{-8} $`。和AdaGrad算法、RMSProp算法以及AdaDelta算法一樣,目標函數自變量中每個元素都分別擁有自己的學習率。最后,使用`$ \boldsymbol{g}_t' $`迭代自變量:

```[tex]

\boldsymbol{x}_t \leftarrow \boldsymbol{x}_{t-1} - \boldsymbol{g}_t'.

```

## 7.8.2 從零開始實現

我們按照Adam算法中的公式實現該算法。其中時間步`$ t $`通過`hyperparams`參數傳入`adam`函數。

``` python

%matplotlib inline

import torch

import sys

sys.path.append("..")

import d2lzh_pytorch as d2l

features, labels = d2l.get_data_ch7()

def init_adam_states():

v_w, v_b = torch.zeros((features.shape[1], 1), dtype=torch.float32), torch.zeros(1, dtype=torch.float32)

s_w, s_b = torch.zeros((features.shape[1], 1), dtype=torch.float32), torch.zeros(1, dtype=torch.float32)

return ((v_w, s_w), (v_b, s_b))

def adam(params, states, hyperparams):

beta1, beta2, eps = 0.9, 0.999, 1e-6

for p, (v, s) in zip(params, states):

v[:] = beta1 * v + (1 - beta1) * p.grad.data

s[:] = beta2 * s + (1 - beta2) * p.grad.data**2

v_bias_corr = v / (1 - beta1 ** hyperparams['t'])

s_bias_corr = s / (1 - beta2 ** hyperparams['t'])

p.data -= hyperparams['lr'] * v_bias_corr / (torch.sqrt(s_bias_corr) + eps)

hyperparams['t'] += 1

```

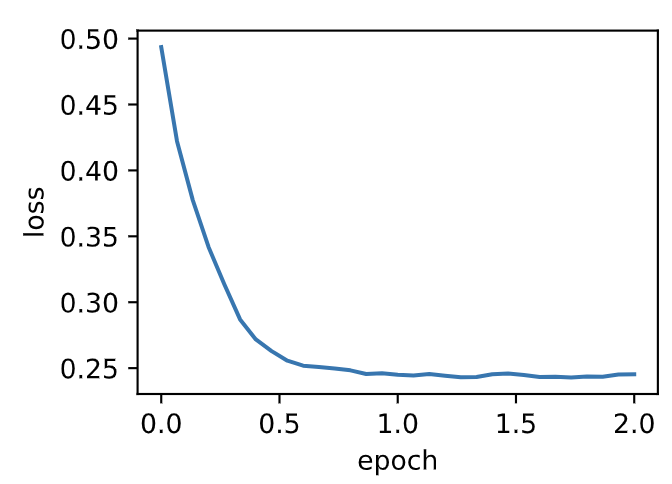

使用學習率為0.01的Adam算法來訓練模型。

``` python

d2l.train_ch7(adam, init_adam_states(), {'lr': 0.01, 't': 1}, features, labels)

```

輸出:

```

loss: 0.245370, 0.065155 sec per epoch

```

:-:

## 7.8.3 簡潔實現

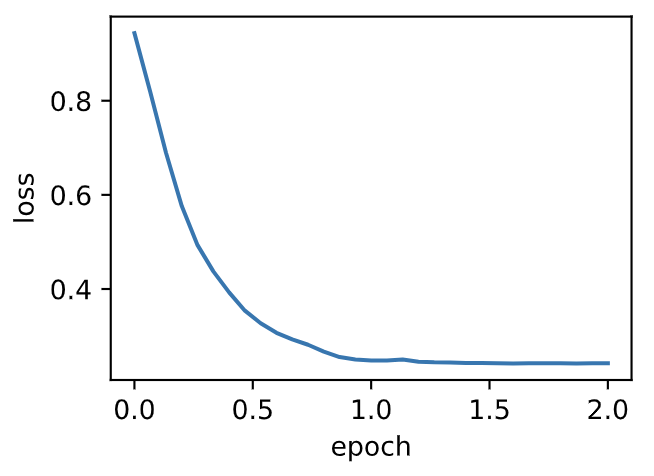

通過名稱為“adam”的`Trainer`實例,我們便可使用Gluon提供的Adam算法。

``` python

d2l.train_pytorch_ch7(torch.optim.Adam, {'lr': 0.01}, features, labels)

```

輸出:

```

loss: 0.242066, 0.056867 sec per epoch

```

:-:

## 小結

* Adam算法在RMSProp算法的基礎上對小批量隨機梯度也做了指數加權移動平均。

* Adam算法使用了偏差修正。

## 參考文獻

[1] Kingma, D. P., & Ba, J. (2014). Adam: A method for stochastic optimization. arXiv preprint arXiv:1412.6980.

-----------

> 注:除代碼外本節與原書此節基本相同,[原書傳送門](https://zh.d2l.ai/chapter_optimization/adam.html)

- Home

- Introduce

- 1.深度學習簡介

- 深度學習簡介

- 2.預備知識

- 2.1環境配置

- 2.2數據操作

- 2.3自動求梯度

- 3.深度學習基礎

- 3.1 線性回歸

- 3.2 線性回歸的從零開始實現

- 3.3 線性回歸的簡潔實現

- 3.4 softmax回歸

- 3.5 圖像分類數據集(Fashion-MINST)

- 3.6 softmax回歸的從零開始實現

- 3.7 softmax回歸的簡潔實現

- 3.8 多層感知機

- 3.9 多層感知機的從零開始實現

- 3.10 多層感知機的簡潔實現

- 3.11 模型選擇、反向傳播和計算圖

- 3.12 權重衰減

- 3.13 丟棄法

- 3.14 正向傳播、反向傳播和計算圖

- 3.15 數值穩定性和模型初始化

- 3.16 實戰kaggle比賽:房價預測

- 4 深度學習計算

- 4.1 模型構造

- 4.2 模型參數的訪問、初始化和共享

- 4.3 模型參數的延后初始化

- 4.4 自定義層

- 4.5 讀取和存儲

- 4.6 GPU計算

- 5 卷積神經網絡

- 5.1 二維卷積層

- 5.2 填充和步幅

- 5.3 多輸入通道和多輸出通道

- 5.4 池化層

- 5.5 卷積神經網絡(LeNet)

- 5.6 深度卷積神經網絡(AlexNet)

- 5.7 使用重復元素的網絡(VGG)

- 5.8 網絡中的網絡(NiN)

- 5.9 含并行連結的網絡(GoogLeNet)

- 5.10 批量歸一化

- 5.11 殘差網絡(ResNet)

- 5.12 稠密連接網絡(DenseNet)

- 6 循環神經網絡

- 6.1 語言模型

- 6.2 循環神經網絡

- 6.3 語言模型數據集(周杰倫專輯歌詞)

- 6.4 循環神經網絡的從零開始實現

- 6.5 循環神經網絡的簡單實現

- 6.6 通過時間反向傳播

- 6.7 門控循環單元(GRU)

- 6.8 長短期記憶(LSTM)

- 6.9 深度循環神經網絡

- 6.10 雙向循環神經網絡

- 7 優化算法

- 7.1 優化與深度學習

- 7.2 梯度下降和隨機梯度下降

- 7.3 小批量隨機梯度下降

- 7.4 動量法

- 7.5 AdaGrad算法

- 7.6 RMSProp算法

- 7.7 AdaDelta

- 7.8 Adam算法

- 8 計算性能

- 8.1 命令式和符號式混合編程

- 8.2 異步計算

- 8.3 自動并行計算

- 8.4 多GPU計算

- 9 計算機視覺

- 9.1 圖像增廣

- 9.2 微調

- 9.3 目標檢測和邊界框

- 9.4 錨框

- 10 自然語言處理

- 10.1 詞嵌入(word2vec)

- 10.2 近似訓練

- 10.3 word2vec實現

- 10.4 子詞嵌入(fastText)

- 10.5 全局向量的詞嵌入(Glove)

- 10.6 求近義詞和類比詞

- 10.7 文本情感分類:使用循環神經網絡

- 10.8 文本情感分類:使用卷積網絡

- 10.9 編碼器--解碼器(seq2seq)

- 10.10 束搜索

- 10.11 注意力機制

- 10.12 機器翻譯