# Wistia 如何每小時處理數百萬個請求并處理豐富的視頻分析

> 原文: [http://highscalability.com/blog/2015/11/23/how-wistia-handles-millions-of-requests-per-hour-and-process.html](http://highscalability.com/blog/2015/11/23/how-wistia-handles-millions-of-requests-per-hour-and-process.html)

<iframe align="RIGHT" height="188" src="https://www.youtube.com/embed/bAEjtLy6G4I?rel=0" style="padding:2px" width="205"></iframe>*這是來自 [Christophe Limpalair](https://twitter.com/ScaleYourCode) 的來賓[轉貼](https://scaleyourcode.com/interviews/interview/18),他在接受 [Max Schnur](https://twitter.com/maxschnur) 采訪時,在 [Wistia [](http://wistia.com/) 。*

Wistia 是企業視頻托管。 他們提供像熱圖一樣的視頻分析,并且使您能夠添加號召性用語。 我真的很想了解所有不同組件的工作方式以及它們如何流式傳輸大量視頻內容,因此這是本集重點介紹的內容。

## Wistia 的堆棧是什么樣的?

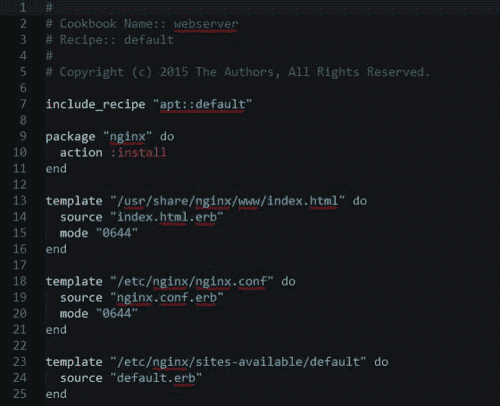

正如您將看到的,Wistia 由不同的部分組成。 以下是支持這些不同部分的一些技術:

* [HAProxy](http://www.haproxy.org/)

* [Nginx](http://nginx.org/)

* [MySQL](https://www.mysql.com/) (共享)

* [Ruby on Rails](http://rubyonrails.org/)

* [獨角獸](http://unicorn.bogomips.org/)和某些服務在 [Puma](http://puma.io/) 上運行

* [nsq](https://github.com/wistia/nsq-ruby) (他們編寫了 Ruby 庫)

* [Redis](http://redis.io/) (正在緩存)

* [Sidekiq](http://sidekiq.org/) 用于異步作業

## 您的規模是多少?

[Wistia](http://wistia.com/) 包含三個主要部分:

1. Wistia 應用程序(用戶登錄并與該應用程序互動的“樞紐”)

2. 酒廠(統計處理)

3. 面包店(轉碼和投放)

以下是一些統計信息:

* **每小時加載 150 萬個播放器**(加載一個播放器的頁面計為一個。兩個播放器計為兩個,依此類推……)

* **每小時向其 Fastly CDN 發出 1880 萬個高峰請求**

* **每小時 740,000 個應用程序請求**

* **每小時轉碼 12,500 個視頻**

* **每小時 150,000 播放**

* **每小時統計 ping 達 800 萬次**

它們在 [Rackspace](http://www.rackspace.com/) 上運行。

## 接收視頻,對其進行處理然后為它們提供服務會帶來什么挑戰?

1. **They want to balance quality and deliverability**, which has two sides to it:

1. 原始視頻的編碼派生

2. 知道何時玩哪個衍生品

在這種情況下,衍生產品是視頻的不同版本。 具有不同質量的版本很重要,因為它使您可以減小文件的大小。 這些較小的視頻文件可以以較少的帶寬提供給用戶。 否則,他們將不得不不斷緩沖。 有足夠的帶寬? 大! 您可以享受更高質量(更大)的文件。

擁有這些不同的版本并知道何時播放哪個版本對于良好的用戶體驗至關重要。

2. **很多 I / O。** 當用戶同時上傳視頻時,最終將不得不在群集之間移動許多繁重的文件。 這里很多事情都會出錯。

3. **波動率。** 請求數量和要處理的視頻數量均存在波動。 他們需要能夠承受這些變化。

4. **當然,提供視頻也是一個主要挑戰。** 幸運的是,CDN 具有不同類型的配置來幫助實現這一目標。

5. **在客戶端,有很多不同的瀏覽器,設備大小等...** 如果您曾經不得不處理使網站具有響應能力或在較舊的 IE 版本上工作,那么您確切地知道我們 在這里談論。

## 您如何處理視頻上傳數量的重大變化?

他們有被稱為 *Primes* 的盒子。 這些 Prime 盒子負責接收用戶上傳的文件。

如果上載開始占用所有可用磁盤空間,則它們可以使用 Chef 食譜啟動新的 Prime。 目前,這是一項手動工作,但通常情況下,他們無法達到極限。 他們有很多空間。

## 您使用哪種轉碼系統?

轉碼部分是他們所謂的*面包店*。

面包房由我們剛剛看過的 Prime 組成,可以接收和提供文件。 他們也有一群工人。 工作者處理任務并從上傳的視頻創建派生文件。

這部分需要強壯的系統,因為它非常消耗資源。 多強壯

我們說的是數百名工人。 每個工人通常一次執行兩項任務。 它們都具有 8 GB 的 RAM 和相當強大的 CPU。

工人要進行什么樣的任務和處理? 他們主要使用 x264 編碼視頻,這是一種快速編碼方案。 通常可以將視頻編碼為視頻長度的一半或三分之一。

視頻還必須調整[的大小](http://www.movavi.com/support/how-to/resizing-video.html),并且它們需要不同的[比特率](http://help.encoding.com/knowledge-base/article/understanding-bitrates-in-video-files/)版本。

此外,針對不同設備的編碼配置文件也不同,例如 iPhone 的 [HLS](http://www.streamingmedia.com/Articles/Editorial/Featured-Articles/How-to-Encode-Video-for-HLS-Delivery-95251.aspx) 。 對于同樣也是 x264 編碼的 Flash 派生,這些編碼需要加倍。

## 上傳視頻并對其進行轉碼的整個過程是什么樣的?

用戶上傳視頻后,該視頻將排隊并發送給工作人員進行轉碼,然后緩慢地轉移到 S3。

無需立即將視頻發送到 S3,而是將其推送到群集中的 Prime,以便客戶可以立即提供視頻。 然后,在幾個小時內,文件被推到 S3 進行永久存儲,并從 Prime 清除以騰出空間。

## 處理完視頻后如何將其提供給客戶?

當您播放 Wistia 上托管的視頻時,您需要請求 embed.wistia.com/video-url,該請求實際上是在播放 CDN(他們使用了幾種不同的 CDN。我只是嘗試了一下,而我通過了 [Akamai](https://www.akamai.com/) )。 CDN 可以追溯到 Origin,這就是我們剛剛談到的 Prime。

Primes 通過稱為“面包路線”的特殊平衡器運行 HAProxy。 面包路由是位于 Prime 前面并平衡流量的路由層。

Wistia 可能將文件本地存儲在群集中(這將更快地提供服務),而 Breadroute 足夠聰明,可以知道這一點。 如果真是這樣,那么 Nginx 將直接從文件系統提供文件。 否則,它們代理 S3。

## 您如何分辨要加載的視頻質量?

這主要是在客戶端決定的。

Wistia 將在用戶點擊播放后立即接收有關用戶帶寬的數據。 在用戶甚至沒有點擊播放之前,Wistia 都會接收有關設備,嵌入視頻的大小以及其他啟發式方法的數據,以確定該特定請求的最佳資產。

僅當用戶進入全屏狀態時才辯論是否要高清。 當用戶第一次單擊播放時,這使 Wistia 有機會不中斷播放。

## 您怎么知道什么時候不加載視頻? 您如何監控呢?

他們擁有稱為 *pipedream* 的服務,他們在應用程序和嵌入代碼中使用該服務來不斷地將數據發送回去。

如果用戶單擊播放,則會獲得有關其窗口大小,窗口所在位置以及是否緩沖的信息(如果它處于播放狀態,但幾秒鐘后時間沒有改變)。

視頻的一個已知問題是加載時間慢。 Wistia 想知道視頻何時加載緩慢,因此他們嘗試為此跟蹤指標。 不幸的是,他們只知道如果用戶實際上在等待負載完成才慢。 如果用戶的連接速度確實很慢,他們可能會在此之前離開。

這個問題的答案? 心跳。 如果他們收到心跳,卻再也沒有收到游戲,那么用戶可能會保釋。

## 您還收集其他哪些分析?

他們還為客戶收集分析數據。

諸如播放,暫停,搜尋,轉化(輸入電子郵件或點擊號召性用語)之類的分析。 其中一些顯示在熱圖中。 他們還將這些熱圖匯總到顯示參與度的圖表中,例如人們觀看和重看的區域。

## 您如何獲得如此詳細的數據?

播放視頻時,他們使用視頻跟蹤器,該跟蹤器是綁定到播放,暫停和搜索的對象。 該跟蹤器將事件收集到數據結構中。 每 10 到 20 秒一次,它會回傳至 Distillery,該酒廠又找出如何將數據轉換為熱圖。

為什么每個人都不這樣做? 我問他,因為我什至沒有從 YouTube 獲得此類數據。 馬克斯說,原因是因為它非常密集。 釀酒廠處理大量的東西,并擁有一個龐大的數據庫。

( *http://www.cotswoldsdistillery.com/First-Cotswolds-Distillery-Opens* )

## 什么是擴展易用性?

Wistia 擁有約 60 名員工。 一旦開始擴大客戶群,就很難確保繼續保持良好的客戶支持。

它們的最高接觸點是播放和嵌入。 這些因素有很多無法控制的因素,因此必須做出選擇:

1. 不要幫助客戶

2. 幫助客戶,但需要很多時間

這些選擇還不夠好。 取而代之的是,他們追究導致客戶支持問題最多的來源-嵌入式。

嵌入經歷了多次迭代。 為什么? 因為他們經常破產。 不管是 WordPress 做一些奇怪的嵌入,還是 Markdown 破壞嵌入,隨著時間的推移,Wistia 都遇到了很多問題。 為了解決這個問題,他們最終大大簡化了嵌入代碼。

這些更簡單的嵌入代碼在客戶端遇到的問題更少。 盡管確實在后臺增加了更多的復雜性,但是卻導致了更少的支持請求。

這就是 Max 通過擴展易用性的含義。 使客戶更輕松,這樣他們就不必經常與客戶支持聯系。 即使這意味著更多的工程挑戰,對他們來說也是值得的。

縮放易用性的另一個示例是回放。 Max 確實對實現一種客戶端 CDN 負載均衡器感興趣,該負載均衡器確定了從中提供內容的最低延遲服務器(類似于 Netflix 所做的事情)。

## 您現在正在從事哪些項目?

Max 計劃很快啟動的就是他們所說的上載服務器。 這個上載服務器將使他們能夠對上載做很多很酷的事情。

正如我們所討論的那樣,對于大多數上載服務,您必須等待文件到達服務器,然后才能開始轉碼并對其進行處理。

上傳服務器將使上傳時可以進行轉碼。 這意味著客戶可以在視頻完全上傳到系統之前就開始播放他們的視頻。 他們還可以獲取靜止圖像并幾乎立即嵌入

## 結論

我必須嘗試在此摘要中盡可能多地添加信息,而又不要太長。 這意味著我刪去了一些可以真正幫助您的信息。 如果您發現這很有趣,我強烈建議您查看[完整訪談](https://scaleyourcode.com/interviews/interview/18),因為還有更多隱藏的寶石。

您可以觀看,閱讀甚至收聽。 還有一個下載 MP3 的選項,因此您可以聆聽自己的工作方式。 當然,該節目也在 [iTunes](https://itunes.apple.com/tt/podcast/scale-your-code-podcast/id987253051?mt=2) 和 [Stitcher](http://www.stitcher.com/podcast/scaleyourcode?refid=stpr) 上進行。

Thanks for reading, and please let me know if you have any feedback!- Christophe Limpalair (@ScaleYourCode)

您好,HS 讀者們,我希望您從本集中找到有趣且有用的信息。 在很多(當之無愧的)關注焦點集中在 Netflix 和 YouTube 上的時代,Wistia 感覺就像是一顆隱藏的寶石。

我一直在努力改善演出,因此,我敞開雙臂歡迎任何反饋。 受訪者的建議和一般問題也是如此。

謝謝,享受!

很棒的帖子...

這些天,每個人都在后端使用 s3,但是為什么他們不使用彈性代碼轉換器?

您好,感謝您的閱讀/觀看!

RE:為什么我們不使用彈性代碼轉換器。 好吧,如果我們今天要創辦一家視頻托管公司,我們可能最終會使用諸如彈性代碼轉換器或 zencoder 之類的服務。 這是因為要獲得像大規模構建的那樣健壯的系統非常困難,而且這些服務非常好。

但是面包店(我們的轉碼服務)是在彈性轉碼器或 zencoder 出現之前建立的。 而現在,由于這些年來我們投入了大量工作并實施了自動縮放功能,因此它為我們帶來了競爭優勢。 也就是說,我們能夠快速輕松地實施新的編碼方案,并將轉碼與我們的應用程序體驗更加緊密地集成在一起。 例如,我不提一提的服務器允許在仍上傳的同時進行轉碼和回放,這是面包店的特色。 使用任何現有服務都很難做到這一點,但是會極大地改善用戶體驗。

再說一次,我們總是在評估我們的選項,因此,如果有必要將部分或全部轉碼卸載到另一個服務,我們一定會考慮的。 目前,面包店是秘密武器。 :)

嗨,好帖子 看起來您正在 Rackspace 上運行,并且存儲在 S3 上。 為什么不只在 AWS 和 S3 上運行? 謝謝!

- LiveJournal 體系結構

- mixi.jp 體系結構

- 友誼建筑

- FeedBurner 體系結構

- GoogleTalk 架構

- ThemBid 架構

- 使用 Amazon 服務以 100 美元的價格構建無限可擴展的基礎架構

- TypePad 建筑

- 維基媒體架構

- Joost 網絡架構

- 亞馬遜建筑

- Fotolog 擴展成功的秘訣

- 普恩斯的教訓-早期

- 論文:Wikipedia 的站點內部,配置,代碼示例和管理問題

- 擴大早期創業規模

- Feedblendr 架構-使用 EC2 進行擴展

- Slashdot Architecture-互聯網的老人如何學會擴展

- Flickr 架構

- Tailrank 架構-了解如何在整個徽標范圍內跟蹤模因

- Ruby on Rails 如何在 550k 網頁瀏覽中幸存

- Mailinator 架構

- Rackspace 現在如何使用 MapReduce 和 Hadoop 查詢 TB 的數據

- Yandex 架構

- YouTube 架構

- Skype 計劃 PostgreSQL 擴展到 10 億用戶

- 易趣建筑

- FaceStat 的禍根與智慧贏得了勝利

- Flickr 的聯合會:每天進行數十億次查詢

- EVE 在線架構

- Notify.me 體系結構-同步性

- Google 架構

- 第二人生架構-網格

- MySpace 體系結構

- 擴展 Digg 和其他 Web 應用程序

- Digg 建筑

- 在 Amazon EC2 中部署大規模基礎架構的六個經驗教訓

- Wolfram | Alpha 建筑

- 為什么 Facebook,Digg 和 Twitter 很難擴展?

- 全球范圍擴展的 10 個 eBay 秘密

- BuddyPoke 如何使用 Google App Engine 在 Facebook 上擴展

- 《 FarmVille》如何擴展以每月收獲 7500 萬玩家

- Twitter 計劃分析 1000 億條推文

- MySpace 如何與 100 萬個并發用戶一起測試其實時站點

- FarmVille 如何擴展-后續

- Justin.tv 的實時視頻廣播架構

- 策略:緩存 404 在服務器時間上節省了洋蔥 66%

- Poppen.de 建筑

- MocoSpace Architecture-一個月有 30 億個移動頁面瀏覽量

- Sify.com 體系結構-每秒 3900 個請求的門戶

- 每月將 Reddit 打造為 2.7 億頁面瀏覽量時汲取的 7 個教訓

- Playfish 的社交游戲架構-每月有 5000 萬用戶并且不斷增長

- 擴展 BBC iPlayer 的 6 種策略

- Facebook 的新實時消息系統:HBase 每月可存儲 135 億條消息

- Pinboard.in Architecture-付費玩以保持系統小巧

- BankSimple 迷你架構-使用下一代工具鏈

- Riak 的 Bitcask-用于快速鍵/值數據的日志結構哈希表

- Mollom 體系結構-每秒以 100 個請求殺死超過 3.73 億個垃圾郵件

- Wordnik-MongoDB 和 Scala 上每天有 1000 萬個 API 請求

- Node.js 成為堆棧的一部分了嗎? SimpleGeo 說是的。

- 堆棧溢出體系結構更新-現在每月有 9500 萬頁面瀏覽量

- Medialets 體系結構-擊敗艱巨的移動設備數據

- Facebook 的新實時分析系統:HBase 每天處理 200 億個事件

- Microsoft Stack 是否殺死了 MySpace?

- Viddler Architecture-每天嵌入 700 萬個和 1500 Req / Sec 高峰

- Facebook:用于擴展數十億條消息的示例規范架構

- Evernote Architecture-每天有 900 萬用戶和 1.5 億個請求

- TripAdvisor 的短

- TripAdvisor 架構-4,000 萬訪客,200M 動態頁面瀏覽,30TB 數據

- ATMCash 利用虛擬化實現安全性-不變性和還原

- Google+是使用您也可以使用的工具構建的:閉包,Java Servlet,JavaScript,BigTable,Colossus,快速周轉

- 新的文物建筑-每天收集 20 億多個指標

- Peecho Architecture-鞋帶上的可擴展性

- 標記式架構-擴展到 1 億用戶,1000 臺服務器和 50 億個頁面視圖

- 論文:Akamai 網絡-70 個國家/地區的 61,000 臺服務器,1,000 個網絡

- 策略:在 S3 或 GitHub 上運行可擴展,可用且廉價的靜態站點

- Pud 是反堆棧-Windows,CFML,Dropbox,Xeround,JungleDisk,ELB

- 用于擴展 Turntable.fm 和 Labmeeting 的數百萬用戶的 17 種技術

- StackExchange 體系結構更新-平穩運行,Amazon 4x 更昂貴

- DataSift 體系結構:每秒進行 120,000 條推文的實時數據挖掘

- Instagram 架構:1400 萬用戶,1 TB 的照片,數百個實例,數十種技術

- PlentyOfFish 更新-每月 60 億次瀏覽量和 320 億張圖片

- Etsy Saga:從筒倉到開心到一個月的瀏覽量達到數十億

- 數據范圍項目-6PB 存儲,500GBytes / sec 順序 IO,20M IOPS,130TFlops

- 99designs 的設計-數以千萬計的綜合瀏覽量

- Tumblr Architecture-150 億頁面瀏覽量一個月,比 Twitter 更難擴展

- Berkeley DB 體系結構-NoSQL 很酷之前的 NoSQL

- Pixable Architecture-每天對 2000 萬張照片進行爬網,分析和排名

- LinkedIn:使用 Databus 創建低延遲更改數據捕獲系統

- 在 30 分鐘內進行 7 年的 YouTube 可擴展性課程

- YouPorn-每天定位 2 億次觀看

- Instagram 架構更新:Instagram 有何新功能?

- 搜索技術剖析:blekko 的 NoSQL 數據庫

- Pinterest 體系結構更新-1800 萬訪問者,增長 10 倍,擁有 12 名員工,410 TB 數據

- 搜索技術剖析:使用組合器爬行

- iDoneThis-從頭開始擴展基于電子郵件的應用程序

- StubHub 體系結構:全球最大的票務市場背后的驚人復雜性

- FictionPress:在網絡上發布 600 萬本小說

- Cinchcast 體系結構-每天產生 1,500 小時的音頻

- 棱柱架構-使用社交網絡上的機器學習來弄清您應該在網絡上閱讀的內容

- 棱鏡更新:基于文檔和用戶的機器學習

- Zoosk-實時通信背后的工程

- WordPress.com 使用 NGINX 服務 70,000 req / sec 和超過 15 Gbit / sec 的流量

- 史詩般的 TripAdvisor 更新:為什么不在云上運行? 盛大的實驗

- UltraDNS 如何處理數十萬個區域和數千萬條記錄

- 更簡單,更便宜,更快:Playtomic 從.NET 遷移到 Node 和 Heroku

- Spanner-關于程序員使用 NoSQL 規模的 SQL 語義構建應用程序

- BigData 使用 Erlang,C 和 Lisp 對抗移動數據海嘯

- 分析數十億筆信用卡交易并在云中提供低延遲的見解

- MongoDB 和 GridFS 用于內部和內部數據中心數據復制

- 每天處理 1 億個像素-少量競爭會導致大規模問題

- DuckDuckGo 體系結構-每天進行 100 萬次深度搜索并不斷增長

- SongPop 在 GAE 上可擴展至 100 萬活躍用戶,表明 PaaS 未通過

- Iron.io 從 Ruby 遷移到 Go:減少了 28 臺服務器并避免了巨大的 Clusterf ** ks

- 可汗學院支票簿每月在 GAE 上擴展至 600 萬用戶

- 在破壞之前先檢查自己-鱷梨的建筑演進的 5 個早期階段

- 縮放 Pinterest-兩年內每月從 0 到十億的頁面瀏覽量

- Facebook 的網絡秘密

- 神話:埃里克·布魯爾(Eric Brewer)談銀行為什么不是堿-可用性就是收入

- 一千萬個并發連接的秘密-內核是問題,而不是解決方案

- GOV.UK-不是你父親的書庫

- 縮放郵箱-在 6 周內從 0 到 100 萬用戶,每天 1 億條消息

- 在 Yelp 上利用云計算-每月訪問量為 1.02 億,評論量為 3900 萬

- 每臺服務器將 PHP 擴展到 30,000 個并發用戶的 5 條 Rockin'Tips

- Twitter 的架構用于在 5 秒內處理 1.5 億活躍用戶,300K QPS,22 MB / S Firehose 以及發送推文

- Salesforce Architecture-他們每天如何處理 13 億筆交易

- 擴大流量的設計決策

- ESPN 的架構規模-每秒以 100,000 Duh Nuh Nuhs 運行

- 如何制作無限可擴展的關系數據庫管理系統(RDBMS)

- Bazaarvoice 的架構每月發展到 500M 唯一用戶

- HipChat 如何使用 ElasticSearch 和 Redis 存儲和索引數十億條消息

- NYTimes 架構:無頭,無主控,無單點故障

- 接下來的大型聲音如何使用 Hadoop 數據版本控制系統跟蹤萬億首歌曲的播放,喜歡和更多內容

- Google 如何備份 Internet 和數十億字節的其他數據

- 從 HackerEarth 用 Apache 擴展 Python 和 Django 的 13 個簡單技巧

- AOL.com 體系結構如何發展到 99.999%的可用性,每天 800 萬的訪問者和每秒 200,000 個請求

- Facebook 以 190 億美元的價格收購了 WhatsApp 體系結構

- 使用 AWS,Scala,Akka,Play,MongoDB 和 Elasticsearch 構建社交音樂服務

- 大,小,熱還是冷-條帶,Tapad,Etsy 和 Square 的健壯數據管道示例

- WhatsApp 如何每秒吸引近 5 億用戶,11,000 內核和 7,000 萬條消息

- Disqus 如何以每秒 165K 的消息和小于 0.2 秒的延遲進行實時處理

- 關于 Disqus 的更新:它仍然是實時的,但是 Go 摧毀了 Python

- 關于 Wayback 機器如何在銀河系中存儲比明星更多的頁面的簡短說明

- 在 PagerDuty 遷移到 EC2 中的 XtraDB 群集

- 擴展世界杯-Gambify 如何與 2 人組成的團隊一起運行大型移動投注應用程序

- 一點點:建立一個可處理每月 60 億次點擊的分布式系統的經驗教訓

- StackOverflow 更新:一個月有 5.6 億次網頁瀏覽,25 臺服務器,而這一切都與性能有關

- Tumblr:哈希處理每秒 23,000 個博客請求的方式

- 使用 HAProxy,PHP,Redis 和 MySQL 處理 10 億個請求的簡便方法來構建成長型啟動架構

- MixRadio 體系結構-兼顧各種服務

- Twitter 如何使用 Redis 進行擴展-105TB RAM,39MM QPS,10,000 多個實例

- 正確處理事情:通過即時重放查看集中式系統與分散式系統

- Instagram 提高了其應用程序的性能。 這是如何做。

- Clay.io 如何使用 AWS,Docker,HAProxy 和 Lots 建立其 10 倍架構

- 英雄聯盟如何將聊天擴大到 7000 萬玩家-需要很多小兵。

- Wix 的 Nifty Architecture 技巧-大規模構建發布平臺

- Aeron:我們真的需要另一個消息傳遞系統嗎?

- 機器:惠普基于憶阻器的新型數據中心規模計算機-一切仍在變化

- AWS 的驚人規模及其對云的未來意味著什么

- Vinted 體系結構:每天部署數百次,以保持繁忙的門戶穩定

- 將 Kim Kardashian 擴展到 1 億個頁面

- HappyPancake:建立簡單可擴展基金會的回顧

- 阿爾及利亞分布式搜索網絡的體系結構

- AppLovin:通過每天處理 300 億個請求向全球移動消費者進行營銷

- Swiftype 如何以及為何從 EC2 遷移到真實硬件

- 我們如何擴展 VividCortex 的后端系統

- Appknox 架構-從 AWS 切換到 Google Cloud

- 阿爾及利亞通往全球 API 的憤怒之路

- 阿爾及利亞通往全球 API 步驟的憤怒之路第 2 部分

- 為社交產品設計后端

- 阿爾及利亞通往全球 API 第 3 部分的憤怒之路

- Google 如何創造只有他們才能創造的驚人的數據中心網絡

- Autodesk 如何在 Mesos 上實施可擴展事件

- 構建全球分布式,關鍵任務應用程序:Trenches 部分的經驗教訓 1

- 構建全球分布式,關鍵任務應用程序:Trenches 第 2 部分的經驗教訓

- 需要物聯網嗎? 這是美國一家主要公用事業公司從 550 萬米以上收集電力數據的方式

- Uber 如何擴展其實時市場平臺

- 優步變得非常規:使用司機電話作為備份數據中心

- 在不到五分鐘的時間里,Facebook 如何告訴您的朋友您在災難中很安全

- Zappos 的網站與 Amazon 集成后凍結了兩年

- 為在現代時代構建可擴展的有狀態服務提供依據

- 細分:使用 Docker,ECS 和 Terraform 重建基礎架構

- 十年 IT 失敗的五個教訓

- Shopify 如何擴展以處理來自 Kanye West 和 Superbowl 的 Flash 銷售

- 整個 Netflix 堆棧的 360 度視圖

- Wistia 如何每小時處理數百萬個請求并處理豐富的視頻分析

- Google 和 eBay 關于構建微服務生態系統的深刻教訓

- 無服務器啟動-服務器崩潰!

- 在 Amazon AWS 上擴展至 1100 萬以上用戶的入門指南

- 為 David Guetta 建立無限可擴展的在線錄制活動

- Tinder:最大的推薦引擎之一如何決定您接下來會看到誰?

- 如何使用微服務建立財產管理系統集成

- Egnyte 體系結構:構建和擴展多 PB 分布式系統的經驗教訓

- Zapier 如何自動化數十億個工作流自動化任務的旅程

- Jeff Dean 在 Google 進行大規模深度學習

- 如今 Etsy 的架構是什么樣的?

- 我們如何在 Mail.Ru Cloud 中實現視頻播放器

- Twitter 如何每秒處理 3,000 張圖像

- 每天可處理數百萬個請求的圖像優化技術

- Facebook 如何向 80 萬同時觀看者直播

- Google 如何針對行星級基礎設施進行行星級工程設計?

- 為 Mail.Ru Group 的電子郵件服務實施反垃圾郵件的貓捉老鼠的故事,以及 Tarantool 與此相關的內容

- The Dollar Shave Club Architecture Unilever 以 10 億美元的價格被收購

- Uber 如何使用 Mesos 和 Cassandra 跨多個數據中心每秒管理一百萬個寫入

- 從將 Uber 擴展到 2000 名工程師,1000 個服務和 8000 個 Git 存儲庫獲得的經驗教訓

- QuickBooks 平臺

- 美國大選期間城市飛艇如何擴展到 25 億個通知

- Probot 的體系結構-我的 Slack 和 Messenger Bot 用于回答問題

- AdStage 從 Heroku 遷移到 AWS

- 為何將 Morningstar 遷移到云端:降低 97%的成本

- ButterCMS 體系結構:關鍵任務 API 每月可處理數百萬個請求

- Netflix:按下 Play 會發生什么?

- ipdata 如何以每月 150 美元的價格為來自 10 個無限擴展的全球端點的 2500 萬個 API 調用提供服務

- 每天為 1000 億個事件賦予意義-Teads 的 Analytics(分析)管道

- Auth0 體系結構:在多個云提供商和地區中運行

- 從裸機到 Kubernetes

- Egnyte Architecture:構建和擴展多 PB 內容平臺的經驗教訓

- 縮放原理

- TripleLift 如何建立 Adtech 數據管道每天處理數十億個事件

- Tinder:最大的推薦引擎之一如何決定您接下來會看到誰?

- 如何使用微服務建立財產管理系統集成

- Egnyte 體系結構:構建和擴展多 PB 分布式系統的經驗教訓

- Zapier 如何自動化數十億個工作流自動化任務的旅程

- Jeff Dean 在 Google 進行大規模深度學習

- 如今 Etsy 的架構是什么樣的?

- 我們如何在 Mail.Ru Cloud 中實現視頻播放器

- Twitter 如何每秒處理 3,000 張圖像

- 每天可處理數百萬個請求的圖像優化技術

- Facebook 如何向 80 萬同時觀看者直播

- Google 如何針對行星級基礎設施進行行星級工程設計?

- 為 Mail.Ru Group 的電子郵件服務實施反垃圾郵件的貓捉老鼠的故事,以及 Tarantool 與此相關的內容

- The Dollar Shave Club Architecture Unilever 以 10 億美元的價格被收購

- Uber 如何使用 Mesos 和 Cassandra 跨多個數據中心每秒管理一百萬個寫入

- 從將 Uber 擴展到 2000 名工程師,1000 個服務和 8000 個 Git 存儲庫獲得的經驗教訓

- QuickBooks 平臺

- 美國大選期間城市飛艇如何擴展到 25 億條通知

- Probot 的體系結構-我的 Slack 和 Messenger Bot 用于回答問題

- AdStage 從 Heroku 遷移到 AWS

- 為何將 Morningstar 遷移到云端:降低 97%的成本

- ButterCMS 體系結構:關鍵任務 API 每月可處理數百萬個請求

- Netflix:按下 Play 會發生什么?

- ipdata 如何以每月 150 美元的價格為來自 10 個無限擴展的全球端點的 2500 萬個 API 調用提供服務

- 每天為 1000 億個事件賦予意義-Teads 的 Analytics(分析)管道

- Auth0 體系結構:在多個云提供商和地區中運行

- 從裸機到 Kubernetes

- Egnyte Architecture:構建和擴展多 PB 內容平臺的經驗教訓