與 RDDs 類似,轉換允許修改輸入 DStream 中的數據。DStreams 支持許多在普通 Spark RDD 上可用的轉換。一些常見的轉換操作定義如下。

<br/>

**map(func):** 通過函數 func 傳遞源 DStream 的每個元素來返回一個新的DStream。

**flatMap(func):** 與 map 類似,但是每個輸入項可以映射到 0 或多個輸出項。

**filter(func):** 通過只選擇 func 返回 true 的源 DStream 的記錄來返回一個新的 DStream。

**repartition(numPartitions):** 通過創建更多或更少的分區來改變 DStream 中的并行度。

**union(otherStream):** 返回一個新的 DStream,它包含源 DStream 和otherDStream 中元素的并集。

**count():** 通過計算源 DStream 的每個 RDD 中的元素數量,返回一個新的單元素 RDDs DStream。

**reduce(func):** 通過使用函數 func(接受兩個參數并返回一個參數)聚合源DStream 的每個 RDD 中的元素,返回一個新的單元素 RDDs DStream。這個函數應該是結合律和交換律,這樣才能并行計算。

**countByValue():** 當對類型為 K 的元素的 DStream 調用時,返回一個新的 DStream (K,Long)對,其中每個鍵的值是它在源 DStream 的每個 RDD中的頻率。

**reduceByKey(func, [numTasks]):** 當在(K, V)對的 DStream 上調用時,返回一個新的(K, V)對的 DStream,其中每個鍵的值使用給定的 reduce 函數進行聚合。注意:在默認情況下,這將使用 Spark 的默認并行任務數(本地模式為 2,而在集群模式下,該數量由配置屬性 spark.default.parallelism決定)來進行分組。可以傳遞一個可選的 numTasks 參數來設置不同數量的任務。

**join(otherStream, [numTasks]):** 當調用兩個 DStream (K, V)和(K, W)對時,返回一個新的 DStream (K,(V, W))對,每個鍵的所有對的元素。

**cogroup(otherStream, [numTasks]):** 當調用(K, V)和(K, W)對的 DStream 時,返回一個新的(K, Seq[V],Seq[W])元組 DStream。

**transform(func):** 通過對源 DStream 的每個 RDD 應用一個 RDD-to-RDD函數來返回一個新的 DStream。這可以用來在 DStream 上執行任意的RDD 操作。

**updateStateByKey(func):** 返回一個新的“狀態”DStream,其中通過對鍵的前一個狀態和鍵的新值應用給定的函數來更新每個鍵的狀態。這可以用來維護每個鍵的任意狀態數據。

<br/>

相比RDD轉換,DStream有兩個特殊操作:updateStateByKey操作和window操作。

<br/>

# 1. updateStateByKey 操作

updateStateByKey 操作允許維護任意狀態,同時不斷地用新信息更新它。要使用它,必須執行兩個步驟。

(1)定義狀態——狀態可以是任意的數據類型。

(2)定義狀態更新函數——使用一個函數指定如何使用輸入流中的前一個狀態和新值來更新狀態。

<br/>

在每個批處理中,Spark 將對所有現有 keys 應用<mark>狀態更新</mark>功能,而不管它們在批處理中是否有新數據。如果更新函數返回 None,則鍵值對將被刪除。

<br/>

例如:需要維護在整個文本數據流中看到的每個單詞的運行計數。這里,運行計數是狀態,它是一個整數。將更新函數定義如下:

```scala

// 將更新函數

def updateFunction(newValues: Seq[Int],

runningCount: Option[Int]): Option[Int] = {

val newCount = ... //使用前一個運行的計數添加新值以獲得新計數

Some(newCount)

}

// 函數調用示例:

val runningCounts = pairs.updateStateByKey[Int](updateFunction _)

```

<br/>

完整代碼:

```scala

import org.apache.spark.SparkConf

import org.apache.spark.streaming.{Seconds, StreamingContext}

/**

* 使用 Spark Streaming 處理有狀態的數據

*/

object StatefulWordCount {

def main(args: Array[String]) {

val sparkConf = new SparkConf

sparkConf.setAppName("StatefulWordCount").setMaster("local[2]")

val ssc = new StreamingContext(sparkConf, Seconds(5))

ssc.checkpoint(".")

val lines = ssc.socketTextStream("localhost", 6789)

val result = lines.flatMap(_.split(" ")).map((_, 1))

val state = result.updateStateByKey(updateFunction)

state.print()

ssc.start()

ssc.awaitTermination()

}

def updateFunction(currentValues: Seq[Int],

preValues: Option[Int]): Option[Int] = {

val curr = currentValues.sum

val pre = preValues.getOrElse(0)

Some(curr + pre)

}

}

```

<br/>

# 2. window操作

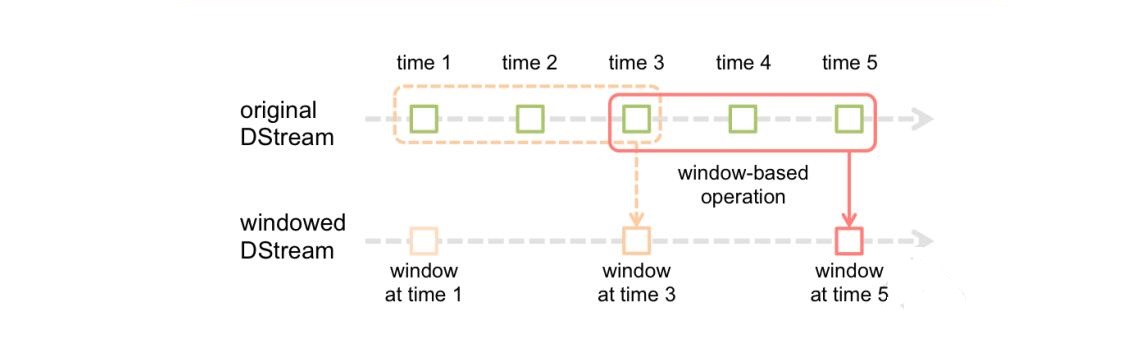

Spark Streaming 還提供了窗口計算,它允許在數據的滑動窗口上應用轉換。下圖演示了這個滑動窗口。

:-:

滑動窗口

<br/>

如圖所示,每當窗口在源 DStream 上滑動時,位于窗口內的源 RDDs 就會被合并并操作,以生成窗口化的 DStream 的 RDDs。在本例中,操作應用于數據的最后 3 個時間單位,幻燈片應用于 2 個時間單位。這表明任何窗口操作都需要指定兩個參數。

* 窗口長度—窗口的持續時間(圖中為 3)。

* 滑動間隔—窗口操作執行的間隔(圖中為 2)。

這兩個參數必須是源 DStream 的批處理間隔的倍數(圖中為 1)。

<br/>

例如,希望通過每 10 秒在最后 30 秒的數據中生成單詞計數來擴展前面的示例。為此,必須在最后 30 秒的數據中對(word, 1)的 DStream 應用 reduceByKey操作,可以使用 reduceByKeyAndWindow 操作完成。

```scala

//每 10 秒對最后 30 秒的數據進行 reduceByKey

val windowedWordCounts = pairs.reduceByKeyAndWindow(

(a:Int,b:Int) => (a + b), Seconds(30), Seconds(10))

```

<br/>

還有一種更通用的方式:`window(windowLength, slideInterval)`。下述代碼效果與上面相同。

```scala

val ssc = new StreamingContext(sc, Seconds(1))

val lines = ssc.socketTextStream("localhost",6789)

val words = lines.window(Seconds(30),Seconds(10)).flatMap(_.split(" "))

val wordCounts = words.map(x => (x, 1)).reduceByKey(_ + _)

wordCounts.print()

ssc.start()

```

- Hadoop

- hadoop是什么?

- Hadoop組成

- hadoop官網

- hadoop安裝

- hadoop配置

- 本地運行模式配置

- 偽分布運行模式配置

- 完全分布運行模式配置

- HDFS分布式文件系統

- HDFS架構

- HDFS設計思想

- HDFS組成架構

- HDFS文件塊大小

- HDFS優缺點

- HDFS Shell操作

- HDFS JavaAPI

- 基本使用

- HDFS的I/O 流操作

- 在SpringBoot項目中的API

- HDFS讀寫流程

- HDFS寫流程

- HDFS讀流程

- NN和SNN關系

- NN和SNN工作機制

- Fsimage和 Edits解析

- checkpoint時間設置

- NameNode故障處理

- 集群安全模式

- DataNode工作機制

- 支持的文件格式

- MapReduce分布式計算模型

- MapReduce是什么?

- MapReduce設計思想

- MapReduce優缺點

- MapReduce基本使用

- MapReduce編程規范

- WordCount案例

- MapReduce任務進程

- Hadoop序列化對象

- 為什么要序列化

- 常用數據序列化類型

- 自定義序列化對象

- MapReduce框架原理

- MapReduce工作流程

- MapReduce核心類

- MapTask工作機制

- Shuffle機制

- Partition分區

- Combiner合并

- ReduceTask工作機制

- OutputFormat

- 使用MapReduce實現SQL Join操作

- Reduce join

- Reduce join 代碼實現

- Map join

- Map join 案例實操

- MapReduce 開發總結

- Hadoop 優化

- MapReduce 優化需要考慮的點

- MapReduce 優化方法

- 分布式資源調度框架 Yarn

- Yarn 基本架構

- ResourceManager(RM)

- NodeManager(NM)

- ApplicationMaster

- Container

- 作業提交全過程

- JobHistoryServer 使用

- 資源調度器

- 先進先出調度器(FIFO)

- 容量調度器(Capacity Scheduler)

- 公平調度器(Fair Scheduler)

- Yarn 常用命令

- Zookeeper

- zookeeper是什么?

- zookeeper完全分布式搭建

- Zookeeper特點

- Zookeeper數據結構

- Zookeeper 內部原理

- 選舉機制

- stat 信息中字段解釋

- 選擇機制中的概念

- 選舉消息內容

- 監聽器原理

- Hadoop 高可用集群搭建

- Zookeeper 應用

- Zookeeper Shell操作

- Zookeeper Java應用

- Hive

- Hive是什么?

- Hive的優缺點

- Hive架構

- Hive元數據存儲模式

- 內嵌模式

- 本地模式

- 遠程模式

- Hive環境搭建

- 偽分布式環境搭建

- Hive命令工具

- 命令行模式

- 交互模式

- Hive數據類型

- Hive數據結構

- 參數配置方式

- Hive數據庫

- 數據庫存儲位置

- 數據庫操作

- 表的創建

- 建表基本語法

- 內部表

- 外部表

- 臨時表

- 建表高階語句

- 表的刪除與修改

- 分區表

- 靜態分區

- 動態分區

- 分桶表

- 創建分桶表

- 分桶抽樣

- Hive視圖

- 視圖的創建

- 側視圖Lateral View

- Hive數據導入導出

- 導入數據

- 導出數據

- 查詢表數據量

- Hive事務

- 事務是什么?

- Hive事務的局限性和特點

- Hive事務的開啟和設置

- Hive PLSQL

- Hive高階查詢

- 查詢基本語法

- 基本查詢

- distinct去重

- where語句

- 列正則表達式

- 虛擬列

- CTE查詢

- 嵌套查詢

- join語句

- 內連接

- 左連接

- 右連接

- 全連接

- 多表連接

- 笛卡爾積

- left semi join

- group by分組

- having刷選

- union與union all

- 排序

- order by

- sort by

- distribute by

- cluster by

- 聚合運算

- 基本聚合

- 高級聚合

- 窗口函數

- 序列窗口函數

- 聚合窗口函數

- 分析窗口函數

- 窗口函數練習

- 窗口子句

- Hive函數

- Hive函數分類

- 字符串函數

- 類型轉換函數

- 數學函數

- 日期函數

- 集合函數

- 條件函數

- 聚合函數

- 表生成函數

- 自定義Hive函數

- 自定義函數分類

- 自定義Hive函數流程

- 添加JAR包的方式

- 自定義臨時函數

- 自定義永久函數

- Hive優化

- Hive性能調優工具

- EXPLAIN

- ANALYZE

- Fetch抓取

- 本地模式

- 表的優化

- 小表 join 大表

- 大表 join 大表

- 開啟Map Join

- group by

- count(distinct)

- 笛卡爾積

- 行列過濾

- 動態分區調整

- 分區分桶表

- 數據傾斜

- 數據傾斜原因

- 調整Map數

- 調整Reduce數

- 產生數據傾斜的場景

- 并行執行

- 嚴格模式

- JVM重用

- 推測執行

- 啟用CBO

- 啟動矢量化

- 使用Tez引擎

- 壓縮算法和文件格式

- 文件格式

- 壓縮算法

- Zeppelin

- Zeppelin是什么?

- Zeppelin安裝

- 配置Hive解釋器

- Hbase

- Hbase是什么?

- Hbase環境搭建

- Hbase分布式環境搭建

- Hbase偽分布式環境搭建

- Hbase架構

- Hbase架構組件

- Hbase數據存儲結構

- Hbase原理

- Hbase Shell

- 基本操作

- 表操作

- namespace

- Hbase Java Api

- Phoenix集成Hbase

- Phoenix是什么?

- 安裝Phoenix

- Phoenix數據類型

- Phoenix Shell

- HBase與Hive集成

- HBase與Hive的對比

- HBase與Hive集成使用

- Hbase與Hive集成原理

- HBase優化

- RowKey設計

- 內存優化

- 基礎優化

- Hbase管理

- 權限管理

- Region管理

- Region的自動拆分

- Region的預拆分

- 到底采用哪種拆分策略?

- Region的合并

- HFile的合并

- 為什么要有HFile的合并

- HFile合并方式

- Compaction執行時間

- Compaction相關控制參數

- 演示示例

- Sqoop

- Sqoop是什么?

- Sqoop環境搭建

- RDBMS導入到HDFS

- RDBMS導入到Hive

- RDBMS導入到Hbase

- HDFS導出到RDBMS

- 使用sqoop腳本

- Sqoop常用命令

- Hadoop數據模型

- TextFile

- SequenceFile

- Avro

- Parquet

- RC&ORC

- 文件存儲格式比較

- Spark

- Spark是什么?

- Spark優勢

- Spark與MapReduce比較

- Spark技術棧

- Spark安裝

- Spark Shell

- Spark架構

- Spark編程入口

- 編程入口API

- SparkContext

- SparkSession

- Spark的maven依賴

- Spark RDD編程

- Spark核心數據結構-RDD

- RDD 概念

- RDD 特性

- RDD編程

- RDD編程流程

- pom依賴

- 創建算子

- 轉換算子

- 動作算子

- 持久化算子

- RDD 與閉包

- csv/json數據源

- Spark分布式計算原理

- RDD依賴

- RDD轉換

- RDD依賴

- DAG工作原理

- Spark Shuffle原理

- Shuffle的作用

- ShuffleManager組件

- Shuffle實踐

- RDD持久化

- 緩存機制

- 檢查點

- 檢查點與緩存的區別

- RDD共享變量

- 廣播變量

- 累計器

- RDD分區設計

- 數據傾斜

- 數據傾斜的根本原因

- 定位導致的數據傾斜

- 常見數據傾斜解決方案

- Spark SQL

- SQL on Hadoop

- Spark SQL是什么

- Spark SQL特點

- Spark SQL架構

- Spark SQL運行原理

- Spark SQL編程

- Spark SQL編程入口

- 創建Dataset

- Dataset是什么

- SparkSession創建Dataset

- 樣例類創建Dataset

- 創建DataFrame

- DataFrame是什么

- 結構化數據文件創建DataFrame

- RDD創建DataFrame

- Hive表創建DataFrame

- JDBC創建DataFrame

- SparkSession創建

- RDD、DataFrame、Dataset

- 三者對比

- 三者相互轉換

- RDD轉換為DataFrame

- DataFrame轉換為RDD

- DataFrame API

- DataFrame API分類

- Action 操作

- 基礎 Dataset 函數

- 強類型轉換

- 弱類型轉換

- Spark SQL外部數據源

- Parquet文件

- Hive表

- RDBMS表

- JSON/CSV

- Spark SQL函數

- Spark SQL內置函數

- 自定SparkSQL函數

- Spark SQL CLI

- Spark SQL性能優化

- Spark GraphX圖形數據分析

- 為什么需要圖計算

- 圖的概念

- 圖的術語

- 圖的經典表示法

- Spark Graphix簡介

- Graphx核心抽象

- Graphx Scala API

- 核心組件

- 屬性圖應用示例1

- 屬性圖應用示例2

- 查看圖信息

- 圖的算子

- 連通分量

- PageRank算法

- Pregel分布式計算框架

- Flume日志收集

- Flume是什么?

- Flume官方文檔

- Flume架構

- Flume安裝

- Flume使用過程

- Flume組件

- Flume工作流程

- Flume事務

- Source、Channel、Sink文檔

- Source文檔

- Channel文檔

- Sink文檔

- Flume攔截器

- Flume攔截器概念

- 配置攔截器

- 自定義攔截器

- Flume可靠性保證

- 故障轉移

- 負載均衡

- 多層代理

- 多路復用

- Kafka

- 消息中間件MQ

- Kafka是什么?

- Kafka安裝

- Kafka本地單機部署

- Kafka基本命令使用

- Topic的生產與消費

- 基本命令

- 查看kafka目錄

- Kafka架構

- Kafka Topic

- Kafka Producer

- Kafka Consumer

- Kafka Partition

- Kafka Message

- Kafka Broker

- 存儲策略

- ZooKeeper在Kafka中的作用

- 副本同步

- 容災

- 高吞吐

- Leader均衡機制

- Kafka Scala API

- Producer API

- Consumer API

- Kafka優化

- 消費者參數優化

- 生產者參數優化

- Spark Streaming

- 什么是流?

- 批處理和流處理

- Spark Streaming簡介

- 流數據處理架構

- 內部工作流程

- StreamingContext組件

- SparkStreaming的編程入口

- WordCount案例

- DStream

- DStream是什么?

- Input DStream與Receivers接收器

- DStream API

- 轉換操作

- 輸出操作

- 數據源

- 數據源分類

- Socket數據源

- 統計HDFS文件的詞頻

- 處理狀態數據

- SparkStreaming整合SparkSQL

- SparkStreaming整合Flume

- SparkStreaming整合Kafka

- 自定義數據源

- Spark Streaming優化策略

- 優化運行時間

- 優化內存使用

- 數據倉庫

- 數據倉庫是什么?

- 數據倉庫的意義

- 數據倉庫和數據庫的區別

- OLTP和OLAP的區別

- OLTP的特點

- OLAP的特點

- OLTP與OLAP對比

- 數據倉庫架構

- Inmon架構

- Kimball架構

- 混合型架構

- 數據倉庫的解決方案

- 數據ETL

- 數據倉庫建模流程

- 維度模型

- 星型模式

- 雪花模型

- 星座模型

- 數據ETL處理

- 數倉分層術語

- 數據抽取方式

- CDC抽取方案

- 數據轉換

- 常見的ETL工具