# 介紹

在數學中,卷積是應用于另一個函數的輸出的函數。在我們的例子中,我們將考慮在圖像上應用矩陣乘法(濾波器)。出于我們的目的,我們將圖像視為數字矩陣。這些數字可以表示像素或甚至圖像屬性。我們將應用于這些矩陣的卷積運算包括在圖像上移動固定寬度的濾波器并應用逐元素乘法來得到我們的結果。

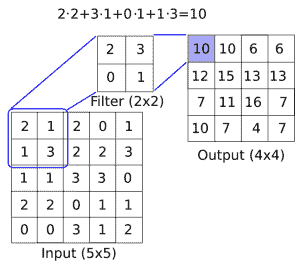

有關圖像卷積如何工作的概念性理解,請參見下圖:

圖 1:如何在圖像上應用卷積濾鏡(長度與寬度之間的深度),以創建新的特征層。這里,我們有一個`2x2`卷積濾波器,在`5x5`輸入的有效空間中操作,兩個方向的步幅為 1。結果是`4x4`矩陣

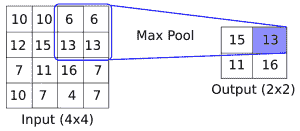

CNN 還具有滿足更多要求的其他操作,例如引入非線性(ReLU)或聚合參數(max P \ pool)以及其他類似操作。上圖是在`5x5`數組上應用卷積運算的示例,其中卷積濾波器是`2x2`矩陣。步長為 1,我們只考慮有效的展示位置。此操作中的可訓練變量將是`2x2`濾波器權重。在卷積之后,通常會跟進聚合操作,例如 max pool。如果我們在兩個方向上采用步幅為 2 的`2x2`區域的最大值,下圖提供了最大池如何操作的示例:

圖 2:Max Pool 操作如何運行的示例。這里,我們有一個`2x2`窗口,在`4x4`輸入的有效空間上操作,兩個方向的步幅為 2。結果是`2x2`矩陣

雖然我們將首先創建自己的 CNN 進行圖像識別,但強烈建議您使用現有的體系結構,我們將在本章的其余部分中進行操作。

> 通常采用預先訓練好的網絡并使用新數據集對其進行重新訓練,并在最后使用新的完全連接層。這種方法非常有用,我們將在重新訓練現有的 CNN 模型秘籍中進行說明,我們將重新訓練現有的體系結構以改進我們的 CIFAR-10 預測。

- TensorFlow 入門

- 介紹

- TensorFlow 如何工作

- 聲明變量和張量

- 使用占位符和變量

- 使用矩陣

- 聲明操作符

- 實現激活函數

- 使用數據源

- 其他資源

- TensorFlow 的方式

- 介紹

- 計算圖中的操作

- 對嵌套操作分層

- 使用多個層

- 實現損失函數

- 實現反向傳播

- 使用批量和隨機訓練

- 把所有東西結合在一起

- 評估模型

- 線性回歸

- 介紹

- 使用矩陣逆方法

- 實現分解方法

- 學習 TensorFlow 線性回歸方法

- 理解線性回歸中的損失函數

- 實現 deming 回歸

- 實現套索和嶺回歸

- 實現彈性網絡回歸

- 實現邏輯回歸

- 支持向量機

- 介紹

- 使用線性 SVM

- 簡化為線性回歸

- 在 TensorFlow 中使用內核

- 實現非線性 SVM

- 實現多類 SVM

- 最近鄰方法

- 介紹

- 使用最近鄰

- 使用基于文本的距離

- 使用混合距離函數的計算

- 使用地址匹配的示例

- 使用最近鄰進行圖像識別

- 神經網絡

- 介紹

- 實現操作門

- 使用門和激活函數

- 實現單層神經網絡

- 實現不同的層

- 使用多層神經網絡

- 改進線性模型的預測

- 學習玩井字棋

- 自然語言處理

- 介紹

- 使用詞袋嵌入

- 實現 TF-IDF

- 使用 Skip-Gram 嵌入

- 使用 CBOW 嵌入

- 使用 word2vec 進行預測

- 使用 doc2vec 進行情緒分析

- 卷積神經網絡

- 介紹

- 實現簡單的 CNN

- 實現先進的 CNN

- 重新訓練現有的 CNN 模型

- 應用 StyleNet 和 NeuralStyle 項目

- 實現 DeepDream

- 循環神經網絡

- 介紹

- 為垃圾郵件預測實現 RNN

- 實現 LSTM 模型

- 堆疊多個 LSTM 層

- 創建序列到序列模型

- 訓練 Siamese RNN 相似性度量

- 將 TensorFlow 投入生產

- 介紹

- 實現單元測試

- 使用多個執行程序

- 并行化 TensorFlow

- 將 TensorFlow 投入生產

- 生產環境 TensorFlow 的一個例子

- 使用 TensorFlow 服務

- 更多 TensorFlow

- 介紹

- 可視化 TensorBoard 中的圖

- 使用遺傳算法

- 使用 k 均值聚類

- 求解常微分方程組

- 使用隨機森林

- 使用 TensorFlow 和 Keras