# COCO 動物數據集和預處理圖像

對于我們的例子,我們將使用 COCO 動物數據集,這是 COCO 數據集的一小部分,由斯坦福大學的研究人員提供,鏈接如下: [http://cs231n.stanford.edu/coco- animals.zip](http://cs231n.stanford.edu/coco-animals.zip) 。 COCO 動物數據集有 800 個訓練圖像和 200 個動物類別的測試圖像:熊,鳥,貓,狗,長頸鹿,馬,綿羊和斑馬。為 VGG16 和 Inception 模型下載和預處理圖像。

對于 VGG 模型,圖像大小為 224 x 224,預處理步驟如下:

1. 將圖像調整為 224×224,其函數類似于來自 TensorFlow 的 `tf.image.resize_image_with_crop_or_pad` 函數。我們實現了這個函數如下:

```py

def resize_image(self,in_image:PIL.Image, new_width,

new_height, crop_or_pad=True):

img = in_image

if crop_or_pad:

half_width = img.size[0] // 2

half_height = img.size[1] // 2

half_new_width = new_width // 2

half_new_height = new_height // 2

img = img.crop((half_width-half_new_width,

half_height-half_new_height,

half_width+half_new_width,

half_height+half_new_height

))

img = img.resize(size=(new_width, new_height))

return img

```

1. 調整大小后,將圖像從 PIL.Image 轉換為 NumPy 數組并檢查圖像是否有深度通道,因為數據集中的某些圖像僅為灰度。

```py

img = self.pil_to_nparray(img)

if len(img.shape)==2:

# greyscale or no channels then add three channels

h=img.shape[0]

w=img.shape[1]

img = np.dstack([img]*3)

```

1. 然后我們從圖像中減去 VGG 數據集平均值以使數據居中。我們將新訓練圖像的數據居中的原因是這些特征具有與用于降雨模型的初始數據類似的范圍。通過在相似范圍內制作特征,我們確保再訓練期間的梯度不會變得太高或太低。同樣通過使數據居中,學習過程變得更快,因為對于以零均值為中心的每個通道,梯度變得均勻。

```py

means = np.array([[[123.68, 116.78, 103.94]]]) #shape=[1, 1, 3]

img = img - means

```

完整的預處理函數如下:

```py

def preprocess_for_vgg(self,incoming, height, width):

if isinstance(incoming, six.string_types):

img = self.load_image(incoming)

else:

img=incoming

img_size = vgg.vgg_16.default_image_size

height = img_size

width = img_size

img = self.resize_image(img,height,width)

img = self.pil_to_nparray(img)

if len(img.shape)==2:

# greyscale or no channels then add three channels

h=img.shape[0]

w=img.shape[1]

img = np.dstack([img]*3)

means = np.array([[[123.68, 116.78, 103.94]]]) #shape=[1, 1, 3]

try:

img = img - means

except Exception as ex:

print('Error preprocessing ',incoming)

print(ex)

return img

```

對于 Inception 模型,圖像大小為 299 x 299,預處理步驟如下:

1. 圖像大小調整為 299 x 299,其函數類似于來自 TensorFlow 的 `tf.image.resize_image_with_crop_or_pad` 函數。我們實現了之前在 VGG 預處理步驟中定義的此函數。

2. 然后使用以下代碼將圖像縮放到范圍`(-1, +1)`:

```py

img = ((img/255.0) - 0.5) * 2.0

```

完整的預處理函數如下:

```py

def preprocess_for_inception(self,incoming):

img_size = inception.inception_v3.default_image_size

height = img_size

width = img_size

if isinstance(incoming, six.string_types):

img = self.load_image(incoming)

else:

img=incoming

img = self.resize_image(img,height,width)

img = self.pil_to_nparray(img)

if len(img.shape)==2:

# greyscale or no channels then add three channels

h=img.shape[0]

w=img.shape[1]

img = np.dstack([img]*3)

img = ((img/255.0) - 0.5) * 2.0

return img

```

讓我們加載 COCO 動物數據集:

```py

from datasetslib.coco import coco_animals

coco = coco_animals()

x_train_files, y_train, x_val_files, x_val = coco.load_data()

```

我們從驗證集中的每個類中取一個圖像,制作列表, `x_test` 并預處理圖像以制作列表 `images_test`:

```py

x_test = [x_val_files[25*x] for x in range(8)]

images_test=np.array([coco.preprocess_for_vgg(x) for x in x_test])

```

我們使用這個輔助函數來顯示與圖像相關的前五個類的圖像和概率:

```py

# helper function

def disp(images,id2label=None,probs=None,n_top=5,scale=False):

if scale:

imgs = np.abs(images + np.array([[[[123.68,

116.78, 103.94]]]]))/255.0

else:

imgs = images

ids={}

for j in range(len(images)):

if scale:

plt.figure(figsize=(5,5))

plt.imshow(imgs[j])

else:

plt.imshow(imgs[j].astype(np.uint8) )

plt.show()

if probs is not None:

ids[j] = [i[0] for i in sorted(enumerate(-probs[j]),

key=lambda x:x[1])]

for k in range(n_top):

id = ids[j][k]

print('Probability {0:1.2f}% of[{1:}]'

.format(100*probs[j,id],id2label[id]))

```

上述函數中的以下代碼恢復為預處理的效果,以便顯示原始圖像而不是預處理圖像:

```py

imgs = np.abs(images + np.array([[[[123.68, 116.78, 103.94]]]]))/255.0

```

在 Inception 模型的情況下,用于反轉預處理的代碼如下:

```py

imgs = (images / 2.0) + 0.5

```

您可以使用以下代碼查看測試圖像:

```py

images=np.array([mpimg.imread(x) for x in x_test])

disp(images)

```

按照 Jupyter 筆記本中的代碼查看圖像。它們看起來都有不同的尺寸,所以讓我們打印它們的原始尺寸:

```py

print([x.shape for x in images])

```

尺寸是:

```py

[(640, 425, 3), (373, 500, 3), (367, 640, 3), (427, 640, 3), (428, 640, 3), (426, 640, 3), (480, 640, 3), (612, 612, 3)]

```

讓我們預處理測試圖像并查看尺寸:

```py

images_test=np.array([coco.preprocess_for_vgg(x) for x in x_test])

print(images_test.shape)

```

維度為:

```py

(8, 224, 224, 3)

```

在 Inception 的情況下,維度是:

```py

(8, 299, 299, 3)

```

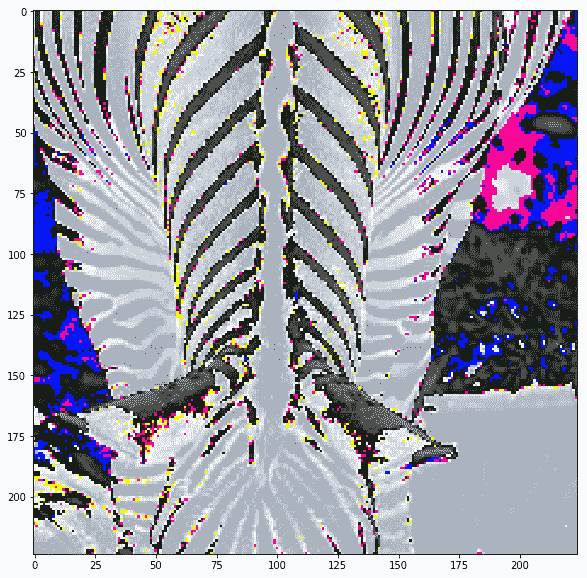

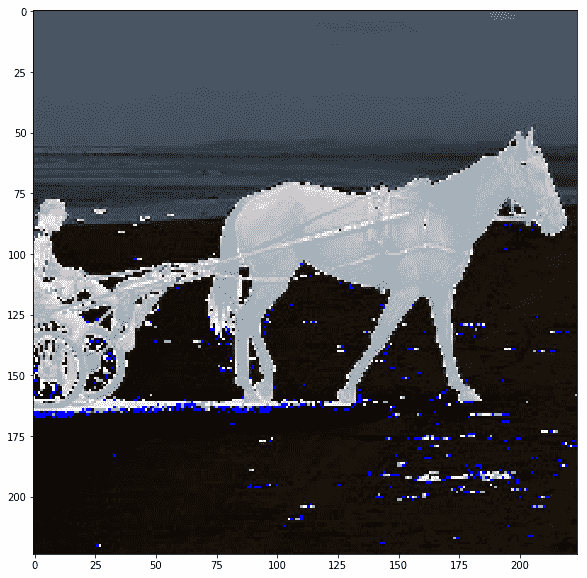

Inception 的預處理圖像不可見,但讓我們打印 VGG 的預處理圖像,以了解它們的外觀:

```py

disp(images_test)

```

| | |

| --- | --- |

|  |  |

|  |  |

|  |  |

|  |  |

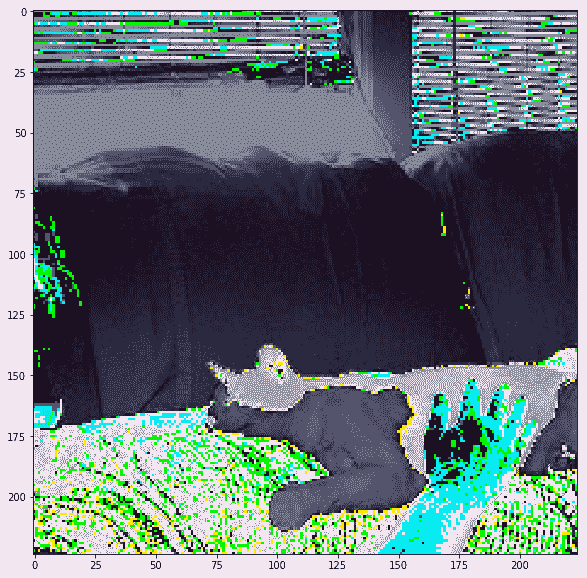

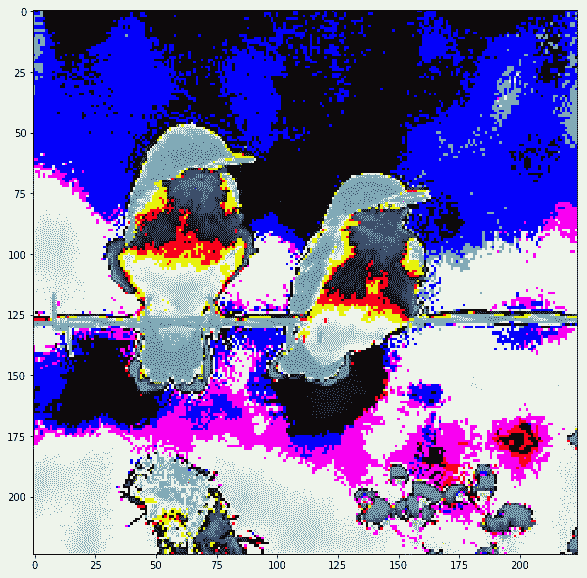

實際上圖像被裁剪了,我們可以看到當我們在保持裁剪的同時反轉預處理時它們的樣子:

| | |

| --- | --- |

|  |  |

|  |  |

|  |  |

|  |  |

現在我們已經有來自 ImageNet 的標簽以及來自 COCO 圖像數據集的圖像和標簽,我們試試遷移學習示例。

- TensorFlow 101

- 什么是 TensorFlow?

- TensorFlow 核心

- 代碼預熱 - Hello TensorFlow

- 張量

- 常量

- 操作

- 占位符

- 從 Python 對象創建張量

- 變量

- 從庫函數生成的張量

- 使用相同的值填充張量元素

- 用序列填充張量元素

- 使用隨機分布填充張量元素

- 使用tf.get_variable()獲取變量

- 數據流圖或計算圖

- 執行順序和延遲加載

- 跨計算設備執行圖 - CPU 和 GPU

- 將圖節點放置在特定的計算設備上

- 簡單放置

- 動態展示位置

- 軟放置

- GPU 內存處理

- 多個圖

- TensorBoard

- TensorBoard 最小的例子

- TensorBoard 詳情

- 總結

- TensorFlow 的高級庫

- TF Estimator - 以前的 TF 學習

- TF Slim

- TFLearn

- 創建 TFLearn 層

- TFLearn 核心層

- TFLearn 卷積層

- TFLearn 循環層

- TFLearn 正則化層

- TFLearn 嵌入層

- TFLearn 合并層

- TFLearn 估計層

- 創建 TFLearn 模型

- TFLearn 模型的類型

- 訓練 TFLearn 模型

- 使用 TFLearn 模型

- PrettyTensor

- Sonnet

- 總結

- Keras 101

- 安裝 Keras

- Keras 中的神經網絡模型

- 在 Keras 建立模型的工作流程

- 創建 Keras 模型

- 用于創建 Keras 模型的順序 API

- 用于創建 Keras 模型的函數式 API

- Keras 層

- Keras 核心層

- Keras 卷積層

- Keras 池化層

- Keras 本地連接層

- Keras 循環層

- Keras 嵌入層

- Keras 合并層

- Keras 高級激活層

- Keras 正則化層

- Keras 噪音層

- 將層添加到 Keras 模型

- 用于將層添加到 Keras 模型的順序 API

- 用于向 Keras 模型添加層的函數式 API

- 編譯 Keras 模型

- 訓練 Keras 模型

- 使用 Keras 模型進行預測

- Keras 的附加模塊

- MNIST 數據集的 Keras 序列模型示例

- 總結

- 使用 TensorFlow 進行經典機器學習

- 簡單的線性回歸

- 數據準備

- 構建一個簡單的回歸模型

- 定義輸入,參數和其他變量

- 定義模型

- 定義損失函數

- 定義優化器函數

- 訓練模型

- 使用訓練的模型進行預測

- 多元回歸

- 正則化回歸

- 套索正則化

- 嶺正則化

- ElasticNet 正則化

- 使用邏輯回歸進行分類

- 二分類的邏輯回歸

- 多類分類的邏輯回歸

- 二分類

- 多類分類

- 總結

- 使用 TensorFlow 和 Keras 的神經網絡和 MLP

- 感知機

- 多層感知機

- 用于圖像分類的 MLP

- 用于 MNIST 分類的基于 TensorFlow 的 MLP

- 用于 MNIST 分類的基于 Keras 的 MLP

- 用于 MNIST 分類的基于 TFLearn 的 MLP

- 使用 TensorFlow,Keras 和 TFLearn 的 MLP 總結

- 用于時間序列回歸的 MLP

- 總結

- 使用 TensorFlow 和 Keras 的 RNN

- 簡單循環神經網絡

- RNN 變種

- LSTM 網絡

- GRU 網絡

- TensorFlow RNN

- TensorFlow RNN 單元類

- TensorFlow RNN 模型構建類

- TensorFlow RNN 單元包裝器類

- 適用于 RNN 的 Keras

- RNN 的應用領域

- 用于 MNIST 數據的 Keras 中的 RNN

- 總結

- 使用 TensorFlow 和 Keras 的時間序列數據的 RNN

- 航空公司乘客數據集

- 加載 airpass 數據集

- 可視化 airpass 數據集

- 使用 TensorFlow RNN 模型預處理數據集

- TensorFlow 中的簡單 RNN

- TensorFlow 中的 LSTM

- TensorFlow 中的 GRU

- 使用 Keras RNN 模型預處理數據集

- 使用 Keras 的簡單 RNN

- 使用 Keras 的 LSTM

- 使用 Keras 的 GRU

- 總結

- 使用 TensorFlow 和 Keras 的文本數據的 RNN

- 詞向量表示

- 為 word2vec 模型準備數據

- 加載和準備 PTB 數據集

- 加載和準備 text8 數據集

- 準備小驗證集

- 使用 TensorFlow 的 skip-gram 模型

- 使用 t-SNE 可視化單詞嵌入

- keras 的 skip-gram 模型

- 使用 TensorFlow 和 Keras 中的 RNN 模型生成文本

- TensorFlow 中的 LSTM 文本生成

- Keras 中的 LSTM 文本生成

- 總結

- 使用 TensorFlow 和 Keras 的 CNN

- 理解卷積

- 了解池化

- CNN 架構模式 - LeNet

- 用于 MNIST 數據的 LeNet

- 使用 TensorFlow 的用于 MNIST 的 LeNet CNN

- 使用 Keras 的用于 MNIST 的 LeNet CNN

- 用于 CIFAR10 數據的 LeNet

- 使用 TensorFlow 的用于 CIFAR10 的 ConvNets

- 使用 Keras 的用于 CIFAR10 的 ConvNets

- 總結

- 使用 TensorFlow 和 Keras 的自編碼器

- 自編碼器類型

- TensorFlow 中的棧式自編碼器

- Keras 中的棧式自編碼器

- TensorFlow 中的去噪自編碼器

- Keras 中的去噪自編碼器

- TensorFlow 中的變分自編碼器

- Keras 中的變分自編碼器

- 總結

- TF 服務:生產中的 TensorFlow 模型

- 在 TensorFlow 中保存和恢復模型

- 使用保護程序類保存和恢復所有圖變量

- 使用保護程序類保存和恢復所選變量

- 保存和恢復 Keras 模型

- TensorFlow 服務

- 安裝 TF 服務

- 保存 TF 服務的模型

- 提供 TF 服務模型

- 在 Docker 容器中提供 TF 服務

- 安裝 Docker

- 為 TF 服務構建 Docker 鏡像

- 在 Docker 容器中提供模型

- Kubernetes 中的 TensorFlow 服務

- 安裝 Kubernetes

- 將 Docker 鏡像上傳到 dockerhub

- 在 Kubernetes 部署

- 總結

- 遷移學習和預訓練模型

- ImageNet 數據集

- 再訓練或微調模型

- COCO 動物數據集和預處理圖像

- TensorFlow 中的 VGG16

- 使用 TensorFlow 中預訓練的 VGG16 進行圖像分類

- TensorFlow 中的圖像預處理,用于預訓練的 VGG16

- 使用 TensorFlow 中的再訓練的 VGG16 進行圖像分類

- Keras 的 VGG16

- 使用 Keras 中預訓練的 VGG16 進行圖像分類

- 使用 Keras 中再訓練的 VGG16 進行圖像分類

- TensorFlow 中的 Inception v3

- 使用 TensorFlow 中的 Inception v3 進行圖像分類

- 使用 TensorFlow 中的再訓練的 Inception v3 進行圖像分類

- 總結

- 深度強化學習

- OpenAI Gym 101

- 將簡單的策略應用于 cartpole 游戲

- 強化學習 101

- Q 函數(在模型不可用時學習優化)

- RL 算法的探索與開發

- V 函數(模型可用時學習優化)

- 強化學習技巧

- 強化學習的樸素神經網絡策略

- 實現 Q-Learning

- Q-Learning 的初始化和離散化

- 使用 Q-Table 進行 Q-Learning

- Q-Network 或深 Q 網絡(DQN)的 Q-Learning

- 總結

- 生成性對抗網絡

- 生成性對抗網絡 101

- 建立和訓練 GAN 的最佳實踐

- 使用 TensorFlow 的簡單的 GAN

- 使用 Keras 的簡單的 GAN

- 使用 TensorFlow 和 Keras 的深度卷積 GAN

- 總結

- 使用 TensorFlow 集群的分布式模型

- 分布式執行策略

- TensorFlow 集群

- 定義集群規范

- 創建服務器實例

- 定義服務器和設備之間的參數和操作

- 定義并訓練圖以進行異步更新

- 定義并訓練圖以進行同步更新

- 總結

- 移動和嵌入式平臺上的 TensorFlow 模型

- 移動平臺上的 TensorFlow

- Android 應用中的 TF Mobile

- Android 上的 TF Mobile 演示

- iOS 應用中的 TF Mobile

- iOS 上的 TF Mobile 演示

- TensorFlow Lite

- Android 上的 TF Lite 演示

- iOS 上的 TF Lite 演示

- 總結

- R 中的 TensorFlow 和 Keras

- 在 R 中安裝 TensorFlow 和 Keras 軟件包

- R 中的 TF 核心 API

- R 中的 TF 估計器 API

- R 中的 Keras API

- R 中的 TensorBoard

- R 中的 tfruns 包

- 總結

- 調試 TensorFlow 模型

- 使用tf.Session.run()獲取張量值

- 使用tf.Print()打印張量值

- 用tf.Assert()斷言條件

- 使用 TensorFlow 調試器(tfdbg)進行調試

- 總結

- 張量處理單元