# 生成性對抗網絡 101

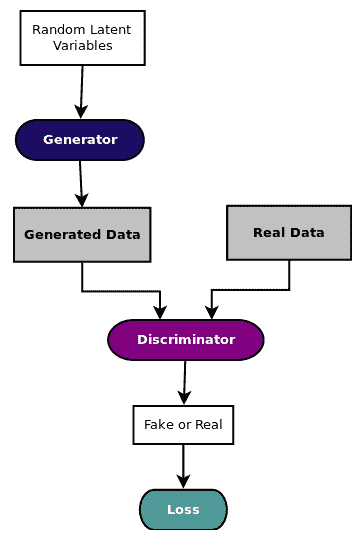

如下圖所示,Generative Adversarial Networks(通常稱為 GAN)有兩個同步工作模型,用于學習和訓練復雜數據,如圖像,視頻或音頻文件:

直觀地,生成器模型從隨機噪聲開始生成數據,但是慢慢地學習如何生成更真實的數據。生成器輸出和實際數據被饋送到判別器,該判別器學習如何區分假數據和真實數據。

因此,生成器和判別器都發揮對抗性游戲,其中生成器試圖通過生成盡可能真實的數據來欺騙判別器,并且判別器試圖不通過從真實數據中識別偽數據而被欺騙,因此判別器試圖最小化分類損失。兩個模型都以鎖步方式進行訓練。

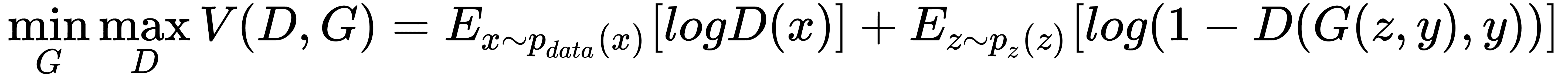

在數學上,生成模型`G(z)`學習概率分布`p(z)`,使得判別器`D(G(z), x)`無法在概率分布`p(z)`和`p(x)`之間進行識別。 GAN 的目標函數可以通過下面描述值函數`V`的等式來描述,(來自 [https://papers.nips.cc/paper/5423-generative-adversarial-nets.pdf](https://papers.nips.cc/paper/5423-generative-adversarial-nets.pdf) ):

可以在以下鏈接中找到 IAN Goodfellow 在 NIPS 2016 上關于 GAN 的開創性教程:

[https://arxiv.org/pdf/1701.00160.pdf.](https://arxiv.org/pdf/1701.00160.pdf)

這個描述代表了一個簡單的 GAN(在文獻中也稱為香草 GAN),由 Goodfellow 在此鏈接提供的開創性論文中首次介紹: [https://arxiv.org/abs/1406.2661](https://arxiv.org/abs/1406.2661) 。從那時起,在基于 GAN 推導不同架構并將其應用于不同應用領域方面進行了大量研究。

例如,在條件 GAN 中,為生成器和判別器網絡提供標簽,使得條件 GAN 的目標函數可以通過以下描述值函數`V`的等式來描述:

描述條件 GAN 的原始論文位于以下鏈接: [https://arxiv.org/abs/1411.1784。](https://arxiv.org/abs/1411.1784)

應用中使用的其他幾種衍生產品及其原始論文,如文本到圖像,圖像合成,圖像標記,樣式轉移和圖像轉移等,如下表所示:

| **GAN 衍生物** | **原始文件** | **演示申請** |

| --- | --- | --- |

| StackGAN | [https://arxiv.org/abs/1710.10916](https://arxiv.org/abs/1710.10916) | 文字到圖像 |

| StackGAN ++ | [https://arxiv.org/abs/1612.03242](https://arxiv.org/abs/1612.03242) | 逼真的圖像合成 |

| DCGAN | [https://arxiv.org/abs/1511.06434](https://arxiv.org/abs/1511.06434) | 圖像合成 |

| HR-DCGAN | [https://arxiv.org/abs/1711.06491](https://arxiv.org/abs/1711.06491) | 高分辨率圖像合成 |

| 有條件的 GAN | [https://arxiv.org/abs/1411.1784](https://arxiv.org/abs/1411.1784) | 圖像標記 |

| InfoGAN | [https://arxiv.org/abs/1606.03657](https://arxiv.org/abs/1606.03657) | 風格識別 |

| Wasserstein GAN | [https://arxiv.org/abs/1701.07875](https://arxiv.org/abs/1701.07875)[https://arxiv.org/abs/1704.00028](https://arxiv.org/abs/1704.00028) | 圖像生成 |

| 耦合 GAN | [https://arxiv.org/abs/1606.07536](https://arxiv.org/abs/1606.07536) | 圖像轉換,域適應 |

| BEGAN | [https://arxiv.org/abs/1703.10717](https://arxiv.org/abs/1703.10717) | Image Generation |

| DiscoGAN | [https://arxiv.org/abs/1703.05192](https://arxiv.org/abs/1703.05192) | 風格轉移 |

| CycleGAN | [https://arxiv.org/abs/1703.10593](https://arxiv.org/abs/1703.10593) | Style Transfer |

讓我們練習使用 MNIST 數據集創建一個簡單的 GAN。在本練習中,我們將使用以下函數將 MNIST 數據集標準化為介于[-1,+ 1]之間:

```py

def norm(x):

return (x-0.5)/0.5

```

我們還定義了 256 維的隨機噪聲,用于測試生成器模型:

```py

n_z = 256

z_test = np.random.uniform(-1.0,1.0,size=[8,n_z])

```

顯示將在本章所有示例中使用的生成圖像的函數:

```py

def display_images(images):

for i in range(images.shape[0]): plt.subplot(1, 8, i + 1)

plt.imshow(images[i])

plt.axis('off')

plt.tight_layout()

plt.show()

```

- TensorFlow 101

- 什么是 TensorFlow?

- TensorFlow 核心

- 代碼預熱 - Hello TensorFlow

- 張量

- 常量

- 操作

- 占位符

- 從 Python 對象創建張量

- 變量

- 從庫函數生成的張量

- 使用相同的值填充張量元素

- 用序列填充張量元素

- 使用隨機分布填充張量元素

- 使用tf.get_variable()獲取變量

- 數據流圖或計算圖

- 執行順序和延遲加載

- 跨計算設備執行圖 - CPU 和 GPU

- 將圖節點放置在特定的計算設備上

- 簡單放置

- 動態展示位置

- 軟放置

- GPU 內存處理

- 多個圖

- TensorBoard

- TensorBoard 最小的例子

- TensorBoard 詳情

- 總結

- TensorFlow 的高級庫

- TF Estimator - 以前的 TF 學習

- TF Slim

- TFLearn

- 創建 TFLearn 層

- TFLearn 核心層

- TFLearn 卷積層

- TFLearn 循環層

- TFLearn 正則化層

- TFLearn 嵌入層

- TFLearn 合并層

- TFLearn 估計層

- 創建 TFLearn 模型

- TFLearn 模型的類型

- 訓練 TFLearn 模型

- 使用 TFLearn 模型

- PrettyTensor

- Sonnet

- 總結

- Keras 101

- 安裝 Keras

- Keras 中的神經網絡模型

- 在 Keras 建立模型的工作流程

- 創建 Keras 模型

- 用于創建 Keras 模型的順序 API

- 用于創建 Keras 模型的函數式 API

- Keras 層

- Keras 核心層

- Keras 卷積層

- Keras 池化層

- Keras 本地連接層

- Keras 循環層

- Keras 嵌入層

- Keras 合并層

- Keras 高級激活層

- Keras 正則化層

- Keras 噪音層

- 將層添加到 Keras 模型

- 用于將層添加到 Keras 模型的順序 API

- 用于向 Keras 模型添加層的函數式 API

- 編譯 Keras 模型

- 訓練 Keras 模型

- 使用 Keras 模型進行預測

- Keras 的附加模塊

- MNIST 數據集的 Keras 序列模型示例

- 總結

- 使用 TensorFlow 進行經典機器學習

- 簡單的線性回歸

- 數據準備

- 構建一個簡單的回歸模型

- 定義輸入,參數和其他變量

- 定義模型

- 定義損失函數

- 定義優化器函數

- 訓練模型

- 使用訓練的模型進行預測

- 多元回歸

- 正則化回歸

- 套索正則化

- 嶺正則化

- ElasticNet 正則化

- 使用邏輯回歸進行分類

- 二分類的邏輯回歸

- 多類分類的邏輯回歸

- 二分類

- 多類分類

- 總結

- 使用 TensorFlow 和 Keras 的神經網絡和 MLP

- 感知機

- 多層感知機

- 用于圖像分類的 MLP

- 用于 MNIST 分類的基于 TensorFlow 的 MLP

- 用于 MNIST 分類的基于 Keras 的 MLP

- 用于 MNIST 分類的基于 TFLearn 的 MLP

- 使用 TensorFlow,Keras 和 TFLearn 的 MLP 總結

- 用于時間序列回歸的 MLP

- 總結

- 使用 TensorFlow 和 Keras 的 RNN

- 簡單循環神經網絡

- RNN 變種

- LSTM 網絡

- GRU 網絡

- TensorFlow RNN

- TensorFlow RNN 單元類

- TensorFlow RNN 模型構建類

- TensorFlow RNN 單元包裝器類

- 適用于 RNN 的 Keras

- RNN 的應用領域

- 用于 MNIST 數據的 Keras 中的 RNN

- 總結

- 使用 TensorFlow 和 Keras 的時間序列數據的 RNN

- 航空公司乘客數據集

- 加載 airpass 數據集

- 可視化 airpass 數據集

- 使用 TensorFlow RNN 模型預處理數據集

- TensorFlow 中的簡單 RNN

- TensorFlow 中的 LSTM

- TensorFlow 中的 GRU

- 使用 Keras RNN 模型預處理數據集

- 使用 Keras 的簡單 RNN

- 使用 Keras 的 LSTM

- 使用 Keras 的 GRU

- 總結

- 使用 TensorFlow 和 Keras 的文本數據的 RNN

- 詞向量表示

- 為 word2vec 模型準備數據

- 加載和準備 PTB 數據集

- 加載和準備 text8 數據集

- 準備小驗證集

- 使用 TensorFlow 的 skip-gram 模型

- 使用 t-SNE 可視化單詞嵌入

- keras 的 skip-gram 模型

- 使用 TensorFlow 和 Keras 中的 RNN 模型生成文本

- TensorFlow 中的 LSTM 文本生成

- Keras 中的 LSTM 文本生成

- 總結

- 使用 TensorFlow 和 Keras 的 CNN

- 理解卷積

- 了解池化

- CNN 架構模式 - LeNet

- 用于 MNIST 數據的 LeNet

- 使用 TensorFlow 的用于 MNIST 的 LeNet CNN

- 使用 Keras 的用于 MNIST 的 LeNet CNN

- 用于 CIFAR10 數據的 LeNet

- 使用 TensorFlow 的用于 CIFAR10 的 ConvNets

- 使用 Keras 的用于 CIFAR10 的 ConvNets

- 總結

- 使用 TensorFlow 和 Keras 的自編碼器

- 自編碼器類型

- TensorFlow 中的棧式自編碼器

- Keras 中的棧式自編碼器

- TensorFlow 中的去噪自編碼器

- Keras 中的去噪自編碼器

- TensorFlow 中的變分自編碼器

- Keras 中的變分自編碼器

- 總結

- TF 服務:生產中的 TensorFlow 模型

- 在 TensorFlow 中保存和恢復模型

- 使用保護程序類保存和恢復所有圖變量

- 使用保護程序類保存和恢復所選變量

- 保存和恢復 Keras 模型

- TensorFlow 服務

- 安裝 TF 服務

- 保存 TF 服務的模型

- 提供 TF 服務模型

- 在 Docker 容器中提供 TF 服務

- 安裝 Docker

- 為 TF 服務構建 Docker 鏡像

- 在 Docker 容器中提供模型

- Kubernetes 中的 TensorFlow 服務

- 安裝 Kubernetes

- 將 Docker 鏡像上傳到 dockerhub

- 在 Kubernetes 部署

- 總結

- 遷移學習和預訓練模型

- ImageNet 數據集

- 再訓練或微調模型

- COCO 動物數據集和預處理圖像

- TensorFlow 中的 VGG16

- 使用 TensorFlow 中預訓練的 VGG16 進行圖像分類

- TensorFlow 中的圖像預處理,用于預訓練的 VGG16

- 使用 TensorFlow 中的再訓練的 VGG16 進行圖像分類

- Keras 的 VGG16

- 使用 Keras 中預訓練的 VGG16 進行圖像分類

- 使用 Keras 中再訓練的 VGG16 進行圖像分類

- TensorFlow 中的 Inception v3

- 使用 TensorFlow 中的 Inception v3 進行圖像分類

- 使用 TensorFlow 中的再訓練的 Inception v3 進行圖像分類

- 總結

- 深度強化學習

- OpenAI Gym 101

- 將簡單的策略應用于 cartpole 游戲

- 強化學習 101

- Q 函數(在模型不可用時學習優化)

- RL 算法的探索與開發

- V 函數(模型可用時學習優化)

- 強化學習技巧

- 強化學習的樸素神經網絡策略

- 實現 Q-Learning

- Q-Learning 的初始化和離散化

- 使用 Q-Table 進行 Q-Learning

- Q-Network 或深 Q 網絡(DQN)的 Q-Learning

- 總結

- 生成性對抗網絡

- 生成性對抗網絡 101

- 建立和訓練 GAN 的最佳實踐

- 使用 TensorFlow 的簡單的 GAN

- 使用 Keras 的簡單的 GAN

- 使用 TensorFlow 和 Keras 的深度卷積 GAN

- 總結

- 使用 TensorFlow 集群的分布式模型

- 分布式執行策略

- TensorFlow 集群

- 定義集群規范

- 創建服務器實例

- 定義服務器和設備之間的參數和操作

- 定義并訓練圖以進行異步更新

- 定義并訓練圖以進行同步更新

- 總結

- 移動和嵌入式平臺上的 TensorFlow 模型

- 移動平臺上的 TensorFlow

- Android 應用中的 TF Mobile

- Android 上的 TF Mobile 演示

- iOS 應用中的 TF Mobile

- iOS 上的 TF Mobile 演示

- TensorFlow Lite

- Android 上的 TF Lite 演示

- iOS 上的 TF Lite 演示

- 總結

- R 中的 TensorFlow 和 Keras

- 在 R 中安裝 TensorFlow 和 Keras 軟件包

- R 中的 TF 核心 API

- R 中的 TF 估計器 API

- R 中的 Keras API

- R 中的 TensorBoard

- R 中的 tfruns 包

- 總結

- 調試 TensorFlow 模型

- 使用tf.Session.run()獲取張量值

- 使用tf.Print()打印張量值

- 用tf.Assert()斷言條件

- 使用 TensorFlow 調試器(tfdbg)進行調試

- 總結

- 張量處理單元